Quand l'IA donne de la voix

Salut les passionnés et les curieux, bienvenue dans cette nouvelle édition de GENERATIVE, la. newsletter hebdomadaire qui décortique l’actualité de l’IA générative, vous présente des outils créatifs et des personnes qui utilisent l’IA de manière éclairante.

Au sommaire cette semaine, des news, une analyse de SORA, le générateur de vidéos made by OpenAI qui secoue la toile depuis une semaine, le programme du prochain meetup de Comptoir IA et l’utilisation de l’IA dans mes réalisations vidéo corporate.

C’est parti !

✔️ Les news de la semaine

✔️ Des nouvelles de Sora

✔️ Et toi, tu fais quoi avec l’IA ? De l’IA dans mes voix off

✔️ Le prochain meetup de comptoir IA

Les news de la semaine

I’m feeling supersonic

Le buzz de la semaine s’appelle Groq, une start-up ambitieuse qui défie Nvidia, le leader des processeurs graphiques, avec son innovation : l'Unité de Traitement du Langage (LPU). Cette nouvelle puce promet d'accélérer considérablement les réponses des modèles de langage tels que ChatGPT, avec une vitesse d'exécution jusqu'à dix fois (!) supérieure et un rapport coût-performance 100 fois meilleur que les solutions Nvidia. Groq se distingue par son GroqChip, qui utilise la SRAM pour une vitesse accrue et une consommation d'énergie réduite, offrant une approche de traitement des données plus efficace et économique comparée aux GPU traditionnels. Bien que Groq semble prêt à bouleverser le marché des LLM, Nvidia reste un concurrent de taille grâce à son écosystème logiciel établi et ses partenariats stratégiques.

Je vous invite à tester par vous même et je vous préviens : ça décoiffe !

Plus c’est petit, plus c’est bon ?

Google a présenté Gemma 2B et 7B, deux nouveaux modèles d'IA open-source plus “légers”. Développés à partir des mêmes technologies que Gemini, les modèles ciblent les chercheurs et développeurs. Accessibles via Kaggle, Hugging Face et Vertex AI, ils permettent de concevoir des applications d'IA.

Avec Gemma 7B, Google cherche à concurrencer directement les modèles open-source de Meta et Mistral AI. Présentés comme pré-entraînés sur des données sélectionnées et adaptées, les modèles visent un "développement responsable". Google fournit même un kit de ressources pour un usage éthique.

UFC Que Choisir

Si l’évolution supersonique des modèles de langage vous déroute, LMSYS (Large Model Systems Organization) pourrait peut être être la clé pour vous y retrouver.

En accédant à leur site, vous découvrirez cinq onglets principaux dédiés aux modèles de langage et d'image à grande échelle.

Les trois premiers onglets vous permettent de tester et comparer les performances de différents modèles de langage, soit en les mettant en compétition de manière aléatoire et anonyme, soit en sélectionnant deux modèles pour une comparaison directe, ou même en engageant une conversation directe avec un modèle spécifique.

Un quatrième onglet est dédié à l'interaction avec des modèles basés sur des images, et un cinquième, le "Leaderboard", compile les évaluations des utilisateurs pour guider vos choix en matière d'intelligence artificielle. Notez que vous avez accès aux versions antérieures des modèles pour observer leur progression et que, malgré les potentiels messages d'erreur dus à une surcharge, il est encouragé de persévérer dans les tests.

Un an d’évolution de vidéo IA

En haut, ce qu'on pouvait faire l’année dernière à la même période. En bas, ce qu’on s’apprête à faire avec Sora. Une année d’écart entre les deux.

P. S. On me souffle dans l'oreillette qu'il s'agit d'une vidéo de parodie réalisée par Will Smith en personne. Pensez vous que Sora produira des résultats proche de la vidéo ci dessus ?

Midjourney sur X ?

Elon Musk a dévoilé des grosses news lors d'une apparition en direct sur Spaces sur X. Il aurait évoqué y compris un partenariat potentiel avec Midjourney (!). Le générateur d'images pourrait être intégré à Grok, le chatbot de X, pour permettre de générer des images directement depuis la plate-forme X.

Voices Marketplace

Eleven Labs, plateforme leader dans le clonage de voix via l'IA, propose désormais un service révolutionnaire permettant aux utilisateurs de cloner leur propre voix et de la louer pour des projets tiers, offrant ainsi une nouvelle source de revenus passifs. Ce service, nommé "Voice Actor Payouts", rémunère les acteurs vocaux chaque fois que leur voix clonée est utilisée, leur permettant de fixer leurs propres tarifs et de contrôler les catégories de contenu pour lesquelles leur voix peut être exploitée.

Et comme par hasard, la jeune startup vient de rejoindre l’incubateur de Disney…

VALENC.IA

La première édition du Concours International de vidéos de Valence (Espagne) créées par Intelligence Artificielle est lancée ! Les participants ont jusqu'au 11 mars pour s'inscrire et tenter de remporter des prix sympathiques, dont un séjour de deux jours à València et une licence d'un an pour la version Illimitée de RunwayML, entre autres récompenses. Pour plus de détails, consultez le site de l’événement.

Pour se mettre dans l’ambiance, voici la vidéo de présentation réalisée par Martin Haerlin.

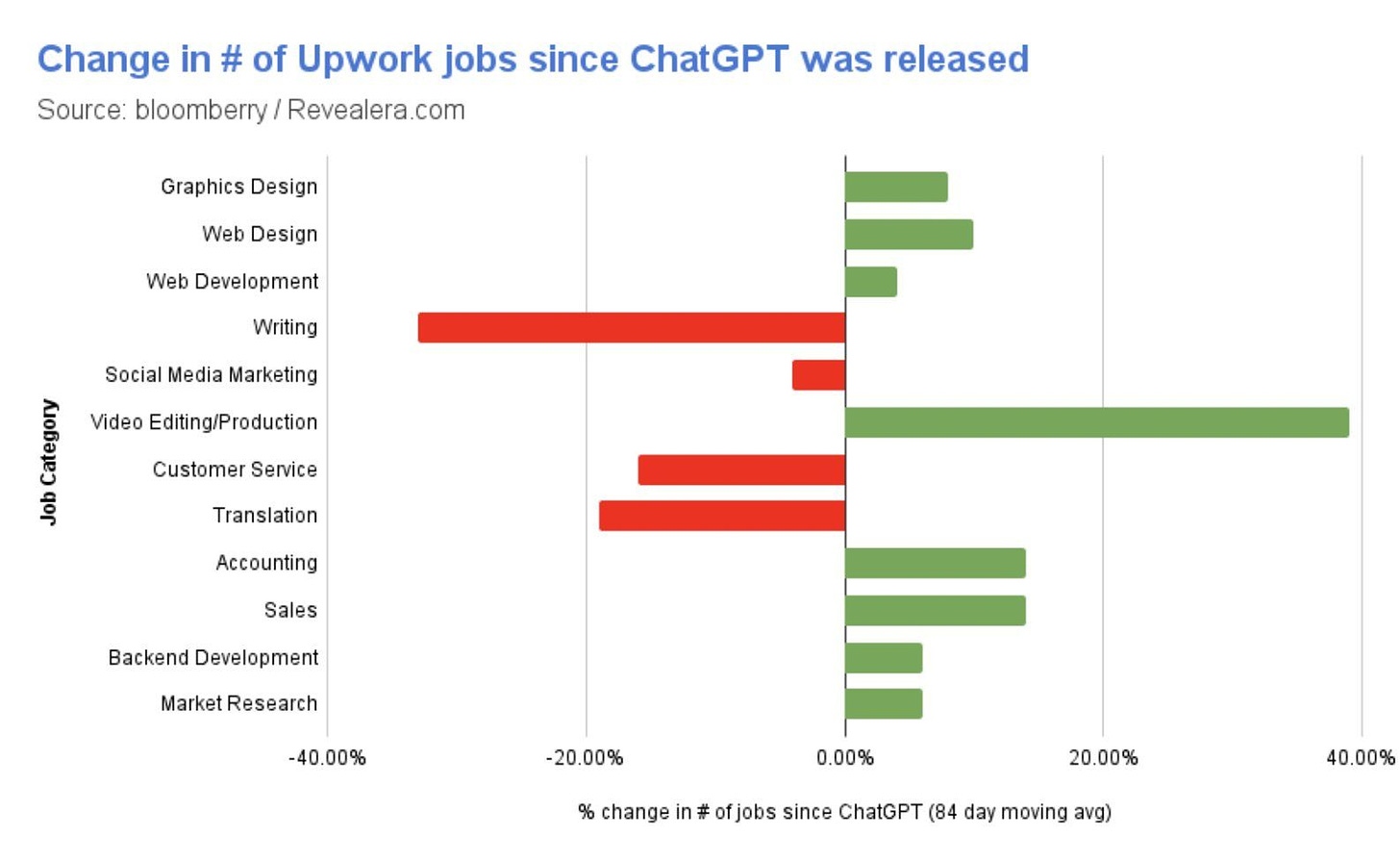

Future of Work

La révolution de l'intelligence artificielle (IA) est en train de remodeler le marché de l'emploi, selon une analyse approfondie des plateformes de freelances. Certains métiers ressentent déjà l'impact de cette transition, tandis que la demande pour des compétences spécialisées en IA explose. Les missions de rédaction ont chuté de plus de 30% suite à l'adoption précoce de nouvelles technologies, et les postes dans le service client sont également en déclin.

En revanche, la demande pour le montage vidéo, le design graphique et le développement web/logiciel reste forte, avec une augmentation des offres d'emploi et des salaires plus élevés. Le développement de chatbots connaît une hausse vertigineuse de 2000% en demande, les entreprises privilégiant l'intégration d'APIs d'IA plutôt que le développement de leurs propres modèles. Face aux inquiétudes croissantes concernant les déplacements d'emplois par l'IA, ces données offrent un aperçu des tendances futures.

Une autre réflexion, c’est que l’écriture va devenir va devenir banale et standardisée. Bien écrire va s’avérer très rare. Il en ira probablement de même pour la production vidéo. Qu’en pensez vous ?

Stable Diffusion 3

La start-up Stability AI a dévoilé hier Stable Diffusion 3, sa dernière version de générateur d'images IA. Grâce à une nouvelle architecture informatique, ce modèle est annoncé comme très supérieur à ses prédécesseurs en termes de qualité visuelle et de précision d’interprétation des prompts. Je suis très impatient de le tester et de le comparer à Midjourney, Leonardo and co.

Stability AI a ouvert une liste d'attente pour un accès anticipé à l’outil. : https://stability.ai/stablediffusion3

Gros Teasing

Selon Sam Altman, le prochain modèle GPT-5 d'OpenAI représentera un bond technologique spectaculaire, comparable au passage du Nokia 3310 à l'iPhone 16.

J’aime son sens de la mesure dans la métaphore.

Décrit comme "bien plus intelligent et grand que ce qu'on peut imaginer", GPT-5 pourrait se rapprocher d'une intelligence artificielle générale. Les rumeurs évoquent des capacités inégalées en compréhension, raisonnement, résolution de problèmes complexes, déchiffrage de langues anciennes et multimodalité. Une sortie anticipée au printemps n'est pas exclue malgré une attente plutôt prévue pour fin 2024.

Des nouvelles de Sora

la semaine dernière, OpenAi a pris le monde entier par surprise en annonçant SORA, son modèle de génération de vidéo dont les extraits ont instantanément ringardisé les leaders de ce domaine (Runway, rien de personnel mais je parle de vous).

J’en ai parlé en détails dans l’édition précédente mais OpenAi continue de publier des vidéos impressionnantes pour montrer l’étendue des capacités de la bête.

Sur X (Twitter), Brett Goldstein a publié un thread très instructif sur le fonctionnement de Sora. Voici ce qu’il écrit :

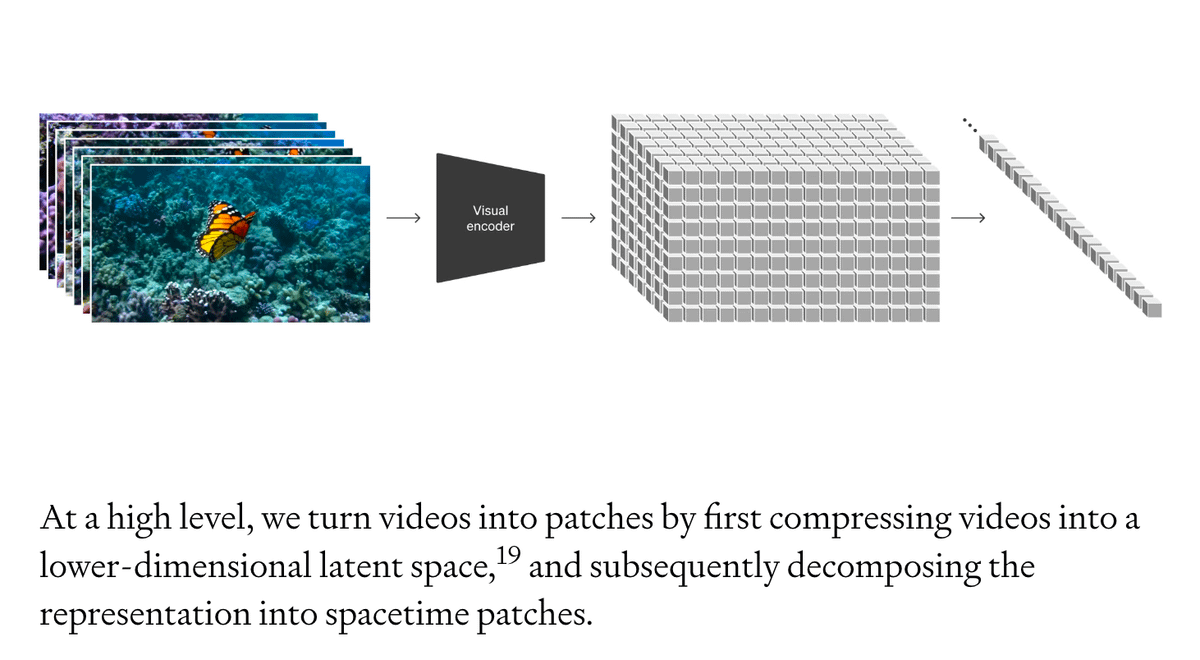

Sora utilise à la fois la diffusion (commençant par du bruit, se raffinant vers une vidéo souhaitée) et des architectures de transformer (gérant les séquences d’images vidéo).

Prompt : "une animation en stop-motion d'une fleur poussant sur le rebord de la fenêtre d'une maison de banlieue."

Sora ne traduit pas directement le texte en images d’une vidéo. Au lieu de cela, il travaille sur des “morceaux d'espace-temps”.

Ces morceaux capturent un instantané de l'espace (ce qui se passe) et du temps (quand cela se passe), comme des mini puzzles vidéo au niveau atomique.

Imaginez donc la vidéo comme un gigantesque cuboïde (espace et temps), et Sora la découpe en plus petits cuboïdes, chacun représentant un extrait d'espace et de temps.

Pour notre exemple :

Premièrement, il commence par disséquer la description et identifie les éléments clés :

• Objets (la fleur en éclosion, le rebord de fenêtre éclairé par le soleil)

• Actions (le déroulement de la croissance dans le temps)

• Lieu (le cadre suburbain)

• Et même les stylisations artistiques (l'esthétique en stop-motion)

Viennent ensuite les morceaux d'espace-temps.

La fleur aspirant à s'épanouir devient un morceau, le rebord de fenêtre baigné de soleil un autre, et la lente croissance à travers le temps un autre. Toutes ces choses agissent comme une séquence de morceaux évoluant à travers la scène vidéo.

Ces morceaux, cependant, ne sont pas juste des fragments aléatoires. Pour les assembler de manière cohérente, Sora dispose de ses graphes de connaissances internes. Ces bases de données contiennent des informations sur le monde physique, comment les objets interagissent, et même sur les styles artistiques.

Cela permet à Sora de comprendre :

• comment la fleur croît de manière réaliste (pétale par pétale)

• comment elle interagit avec la lumière du soleil (les changements d'éclairage dans le temps)

• et adhère à l'esthétique en stop-motion (les transitions image par image).

Ces morceaux individuels créent un “canvas de bruit”

Après cela, les modèles de diffusion prennent chaque morceau bruyant et abstrait et le raffinent progressivement vers son apparence finale.

Chaque pétale de la fleur prend forme, la lumière du soleil devient plus définie, et le style en stop-motion émerge image par image

comme ceci

Tandis que les modèles de diffusion gèrent les morceaux individuels, les transformateurs analysent les relations entre les morceaux à travers le temps.

Ainsi la fleur grandit de manière fluide, la lumière du soleil se déplace naturellement, et l'esthétique en stop-motion reste cohérente à travers la séquence vidéo.

Pixel par pixel

Il peut réaliser toutes sortes de tâches liées à la vidéo.

Text-to-video : Comme nous l'avons vu

Image-to-video : Donner vie aux images fixes

Video-to-video : Changer le style de la vidéo en quelque chose d'autre

Étendre la vidéo dans le temps : Vers l'avant et vers l'arrière

Créer des boucles sans raccord : Mosaïque vidéo infinie

Génération d'images : Une image fixe (jusqu'à 2048 x 2048 pixels)

Générer la vidéo dans n'importe quel format : 16:9, vertical, carré, etc…

Simuler des mondes virtuels : Comme Minecraft et d'autres jeux vidéo

Créer une vidéo : Jusqu'à 1 minute de long avec plusieurs cutdowns

Mais il reste encore du chemin à faire

Il ne reproduit pas avec précision la physique de nombreuses interactions de base

Voyez les gestes de la main étranges de la femme qui salue ici décrits comme "des aliens hyperdimensionnels essayant de comprendre comment paraître humain dans l'espace 3D".

Et toi tu fais quoi avec l’IA ?

Cette semaine je vous parle d’un film corporate que j’ai tourné en fin d’année dernière en Argentine et dans lequel j’ai injecté de l’IA générative.

Le tournage s’est très bien passé, perché sur les hauts plateaux du nord ouest de l’Argentine, à quelques dizaines de kilomètres des frontières boliviennes et chiliennes.

Le challenge est apparu en post prod. Nous avions un temps très réduit pour monter, habiller et sonoriser tous les livrables. Une voix off était prévue mais le texte changeait fréquemment jusqu'au dernier moment.

Face à ces impératifs, j'ai eu l'idée d'expérimenter une voix off IA. J'avais déjà testé par le passé des outils de génération de voix, mais jamais dans le cadre d'un projet professionnel avec une telle durée. J'ai naturellement opté pour Eleven Labs, ma plateforme favorite pour la synthèse vocale. J'ai d'abord étudié attentivement leur librairie vocale avant de sélectionner une voix grave très intéressante, agréable à écouter, avec une sonorité afro-américaine.

La génération a ensuite pris pas mal de temps. Il faut jouer avec les différents paramètres de stabilité, clarté et exagération avant de trouver le bon équilibre, ce processus itératif pouvant s'avérer long. En outre, en intelligence artificielle générative, chaque génération comporte une part d'aléatoire. Ainsi, il peut être chronophage d'essayer d'obtenir un résultat vocal précis, les voix générées variant souvent d'une tentative à l'autre, avec même parfois des bugs (logorrhée de syllabes vides de sens, accents bizarres, etc…)

Au final, le résultat nous a donné satisfaction. Les voix off IA conviennent à des contenus corporate en anglais, un peu moins dans d'autres langues. Et ne permettent pas un contrôle suffisant pour de la publicité. Mais offrent une grande souplesse de modification jusqu'au dernier moment.

Voici le résultat, dites moi ce que vous pensez de la voix !

Un nouveau meetup de Comptoir IA se profile !

Si vous êtes à Paris le 28 février prochain, je ne saurais que trop vous recommander l’incontournable meetup mensuel de Comptoir IA. J’y aurais le plaisir d’animer une session d’open prompting en compagnie de mon confrère Sane Lebrun, auteur de l’excellente newsletter Upmynt.

Au programme ce mois-ci :

Retour sur les news - Sora, Gemini, Biomistral…

Les intervenants ✨ :

Olivier Reynaud, cofondateur de Aive, fera une démo de sa solution.

Caroline Span, récente participante de QVEMA sur M6, présentera la néobanque Welcome Account et l’utilisation de l’IA dans son appli.

Guillaume Avrin, le coordinateur national pour l'intelligence artificielle, fera le point sur l’année écoulée et les chantiers en cours.

Ari Kouts présentera Silicon Symphony, le premier groupe de musique 100% IA dont j’ai parlé récemment ici.

Alexandre Duffaut fondateur de Noota, vous présentera son assistant de réunion IA.

Ainsi que la projection des dernières créations de MatthieuGB, artiste IA en vue.

Les inscriptions se déroulent ici : https://www.meetup.com/comptoir-ia/events/299336134/

Pas de panique si c’est complet, envoyez moi un message, je verrai ce que je peux faire !

Cette édition est terminée, merci de l’avoir lue jusqu’ici ! Si elle vous a plu, vous pouvez la partager en cliquant juste ici :

Vous pouvez également me suivre sur LinkedIn et activer la cloche 🔔, je poste régulièrement sur l’intelligence artificielle générative. Vous pouvez également me contacter pour toute proposition de création, intervention, conférence, projet, formation liée à l’intelligence artificielle générative.

Et n’oubliez pas de vous abonner pour ne rien rater des prochaines éditions 👇