Bienvenue à tous les êtres non artificiels (et aux autres) dans cette nouvelle édition de GENERATIVE.

Au sommaire de ce vendredi :

Les news qu'il ne fallait pas manquer

Les balbutiements du cinéma IA

Le test de Midjourney V5.1

Let's go !

Les news qu'il ne fallait pas manquer

l'IA augmente le Fisc

L'administration fiscale a testé un nouvel outil pour repérer les piscines non déclarées en comparant les constructions du cadastre à des images aériennes et en utilisant un algorithme d'intelligence artificielle. Dans neuf départements, 20 000 piscines non déclarées ont été identifiées, entraînant une réévaluation de la valeur locative des maisons concernées et une augmentation des taxes foncières et d'habitation. Cette hausse d'impôts a représenté près de 10 millions d'euros.

Réunion de crise

La Maison Blanche doit rencontrer des dirigeants de Google, Microsoft, OpenAI et Anthropic pour discuter des risques liés à l'IA.

Sundar Pichai, PDG d'Alphabet, Satya Nadella, PDG de Microsoft, Dario Amodei, PDG d'Anthropic, et Sam Altman, PDG d'OpenAI, participeront à cette réunion.

Cette initiative fait suite à la signature par plusieurs leaders de la technologie d'une lettre ouverte appelant à l'arrêt du développement de l'IA au-delà du GPT-4. Geoffrey Hinton, surnommé le "parrain de l'IA", a lui aussi récemment quitté Google pour mettre en garde le monde contre les dangers à venir, j'en parlais dans l'édition précédente de GENERATIVE :

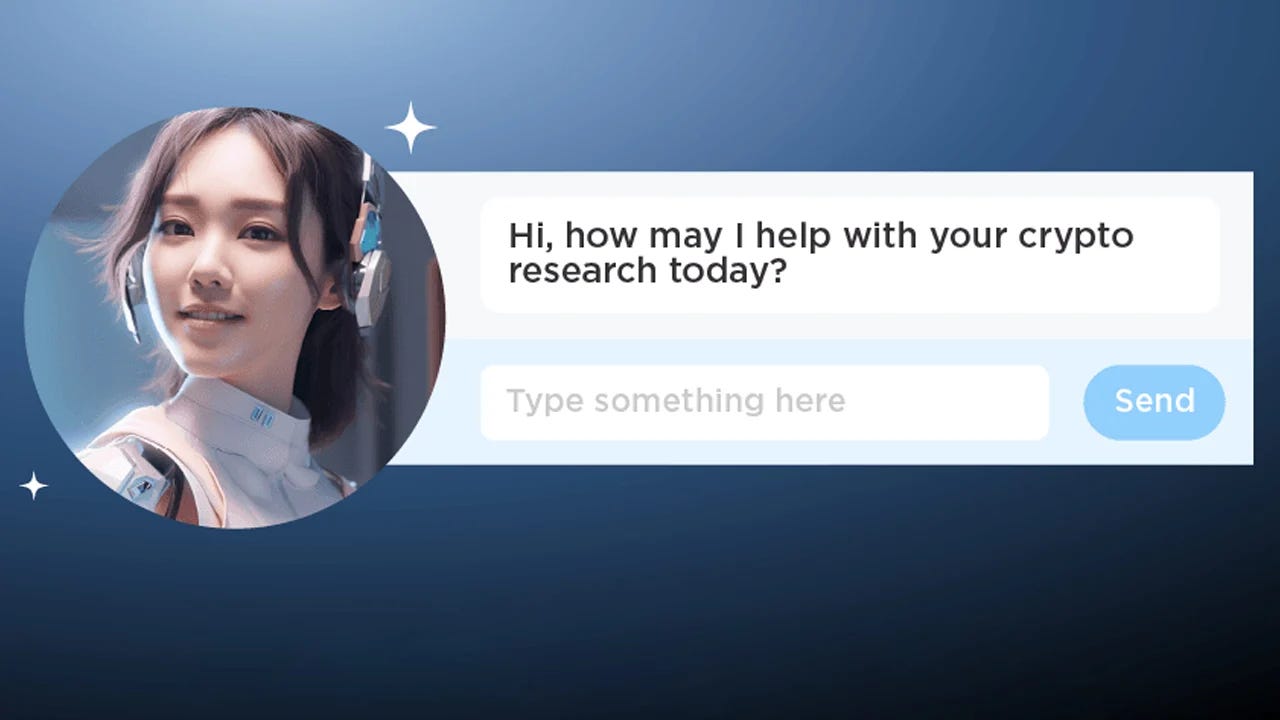

Un crypto chatbot

Crypto.com, l'une des plus grandes plateformes de crypto-monnaies au monde, vient de présenter son chatbot IA, "Amy".

Amy est un assistant IA basé sur ChatGPT et conçu pour informer les utilisateurs sur l'industrie des crypto-monnaies, notamment sur les cours des cryptos en temps réel, les nouveaux projets et les événements historiques. Cette initiative fait suite au récent chatbot "Sensei" de Binance, dont je parlerai prochainement plus en détails.

On espère juste qu'il ne fera pas de prédiction du cours du Bitcoin ni des conseils en investissement 😁

Tout apprendre avec ChatGPT ?

Les modèles de langage ont la capacité surprenante d'adopter différents personnages ou agents en fonction de la manière dont vous les sollicitez.

Des développeurs ont créé "M. Ranedeer" un tuteur pour GPT4 qui ambitionne de proposer un outil pédagogique puissant pour apprendre des concepts qui ne vous sont pas familiers.

Avec ce Tuteur IA, vous pouvez :

adapter la profondeur des connaissances à vos besoins d'apprentissage.

Personnaliser votre style d'apprentissage, votre type de communication, votre ton et votre cadre de raisonnement.

Fine tuner votre tuteur pour le tailler sur mesure pour vous.

Il propose 10 niveaux d'apprentissage :

1. Surface level understanding

2. Expanded understanding

3. Detailed analysis

4. Practical application

5. Advanced concepts

6. Critical evaluation

7. Synthesis and integration

8. Expert insight

9. Specialization

10. "Cutting-edge research"

Plusieurs styles d'apprentissage :

Sensing, Visual* (requires plugins), Inductive, Active, Sequential, Intuitive, Verbal, Deductive, Reflective, Global

Plusieurs tons et styles d'écriture, etc... L'outil est 100% paramétrable pour s'adapter aux besoins de chacun.

Impressionnant.

https://github.com/JushBJJ/Mr.-Ranedeer-AI-Tutor?utm_source=tldrai#mr-ranedeer-your-personalized-ai-tutor

A votre avis, quel scénario prévaudra dans le futur : ce type de tuteur personnalisé pour apprendre en continu ou à l'inverse des oreillettes connectées avec un chatbot intégré pour éviter d'avoir à apprendre ?

Ou peut être qu'il n'y aura plus de chatbots dans le futur ?

C'est ce que pense Amelia Wattenberger, ingénieur de recherche, qui dans un article récent intitulé "Boo, Chatbots", examine les limites de la technologie actuelle des chatbots et affirme qu'ils ne répondent souvent pas aux attentes des utilisateurs. Tout en reconnaissant les avantages potentiels des chatbots, tels que leur capacité à fournir des réponses instantanées et à gérer des tâches simples, elle met l'accent sur leur incapacité à comprendre le contexte, à gérer des requêtes ambiguës ou à faire preuve d'empathie.

Selon Mme Wattenberger, les limites des chatbots proviennent de leur dépendance à l'égard de scripts et d'arbres de décision prédéfinis, ce qui peut conduire à des interactions improductives si la demande de l'utilisateur ne correspond pas exactement aux catégories prédéterminées du chatbot. En outre, elle explique que la technologie qui sous-tend les chatbots, à savoir le traitement du langage naturel (NLP), n'a pas encore suffisamment progressé pour leur permettre de comprendre le contexte ou de gérer l'ambiguïté de la même manière que les humains.

Amelia Wattenberger aborde également les implications éthiques de l'utilisation des chatbots, en particulier lorsqu'ils sont employés pour remplacer des travailleurs humains. Elle souligne le fait que les chatbots manquent d'empathie et de compétences sociales, ce qui peut entraîner une rupture entre l'utilisateur et le fournisseur de services. Cela peut à son tour entraîner des expériences négatives pour l'utilisateur.

Cela me rappelle une réponse de ChatGPT qui listait les professeurs parmi les métiers irremplaçables par l'IA, car les humains ont besoin d'interactions sociales pour apprendre de manière optimale.

En conclusion, A. Wattenberger estime que si les chatbots peuvent jouer un rôle dans l'automatisation de certaines tâches, les développeurs et les entreprises ne devraient pas s'en servir pour remplacer complètement l'interaction humaine. Ils devraient plutôt être utilisés pour augmenter les capacités humaines et améliorer l'expérience globale du client.

Et vous, qu'en pensez-vous ?

Les balbutiements du cinéma IA

Il y a quelques mois, je m'amusais en créant des visuels de films qui n'existent pas, avec Midjourney v4.

Par exemple :

The Matrix directed by Wes Anderson

“Avengers, directed by Fritz Lang”

Et bien sûr :

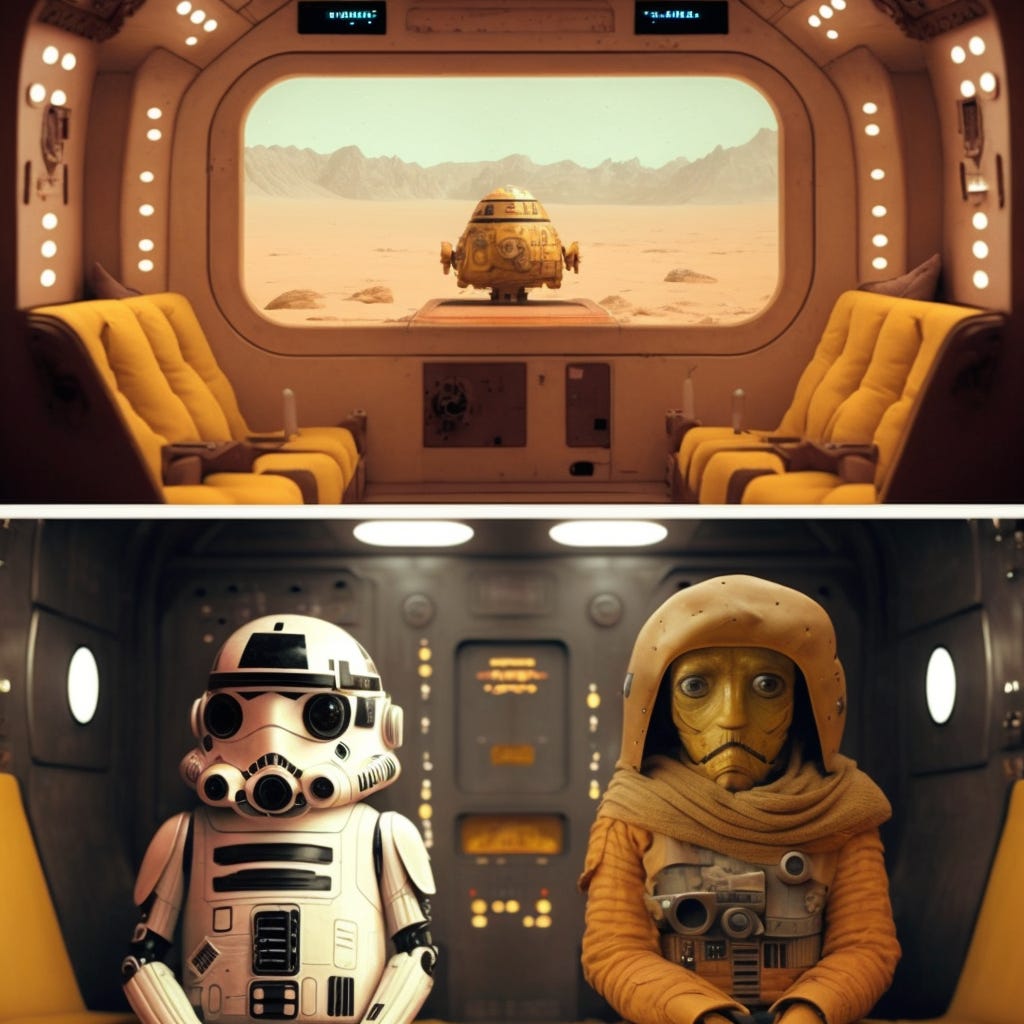

“Star Wars directed by Wes Anderson”

Récemment, un fanmade trailer est apparu sur Youtube entraînant des débats passionnés sur Twitter.

Créée par le réalisateur Caleb Ward pour sa chaîne Youtube “Curious Refug”e, la bande annonce s'intitule “The Galactic Ménagerie” et a déjà dépassé le million de vues

"J'étais curieux de voir comment les outils d'IA générative pouvaient être utilisés dans un contexte cinématographique. J'ai décidé de combiner différents outils IA pour créer une vidéo", explique Caleb Ward, qui précise que l'idée a été inspirée par le succès des vidéos Harry Potter by Balenciaga, une série de clips sur Harry Potter générés par l'IA qui est devenue virale en avril. Pour mémoire :

"D'une certaine manière, l'IA était le réalisateur, je n'ai joué qu'un rôle secondaire", explique-t-il à propos du processus créatif, soulignant que "l'idée de base, le scénario, la liste des plans, les scènes, les animations, la description et les tags" de la bande-annonce ont tous été conçus à l'aide d'outils d’IA.

"Au lieu d'engager un comédien, j'ai utilisé un générateur de voix off. Chaque fois que j'ai eu besoin d'élements scénaristiques, j'ai simplement demandé à ChatGPT d'en écrire.

Chaque fois que Midjourney créait une nouvelle image, j'étais ravi de voir le résultat", ajoute-t-il.

“En tant que fan, je suis très enthousiaste à l'idée de ce nouveau chapitre créatif de la narration", ajoute-t-il. "J'aime les conversations que cette vidéo a déclenchées et j'espère continuer à travailler avec des réalisateurs pour explorer les possibilités de l'IA en matière de narration et enseigner aux conteurs en herbe comment libérer leur potentiel créatif."

A la vitesse à laquelle l'IA generative évolue, quand pensez vous qu'un long métrage AI generated sortira au cinéma ?

Et iriez vous le voir ?

Midjourney 5.1 est sorti !

Et il semble combler le gap entre la v4 très "arty" et la V5 très photoréaliste. Il est supposé fonctionner mieux que la v5 avec des prompts courts, le rendant plus accessible aux débutants.

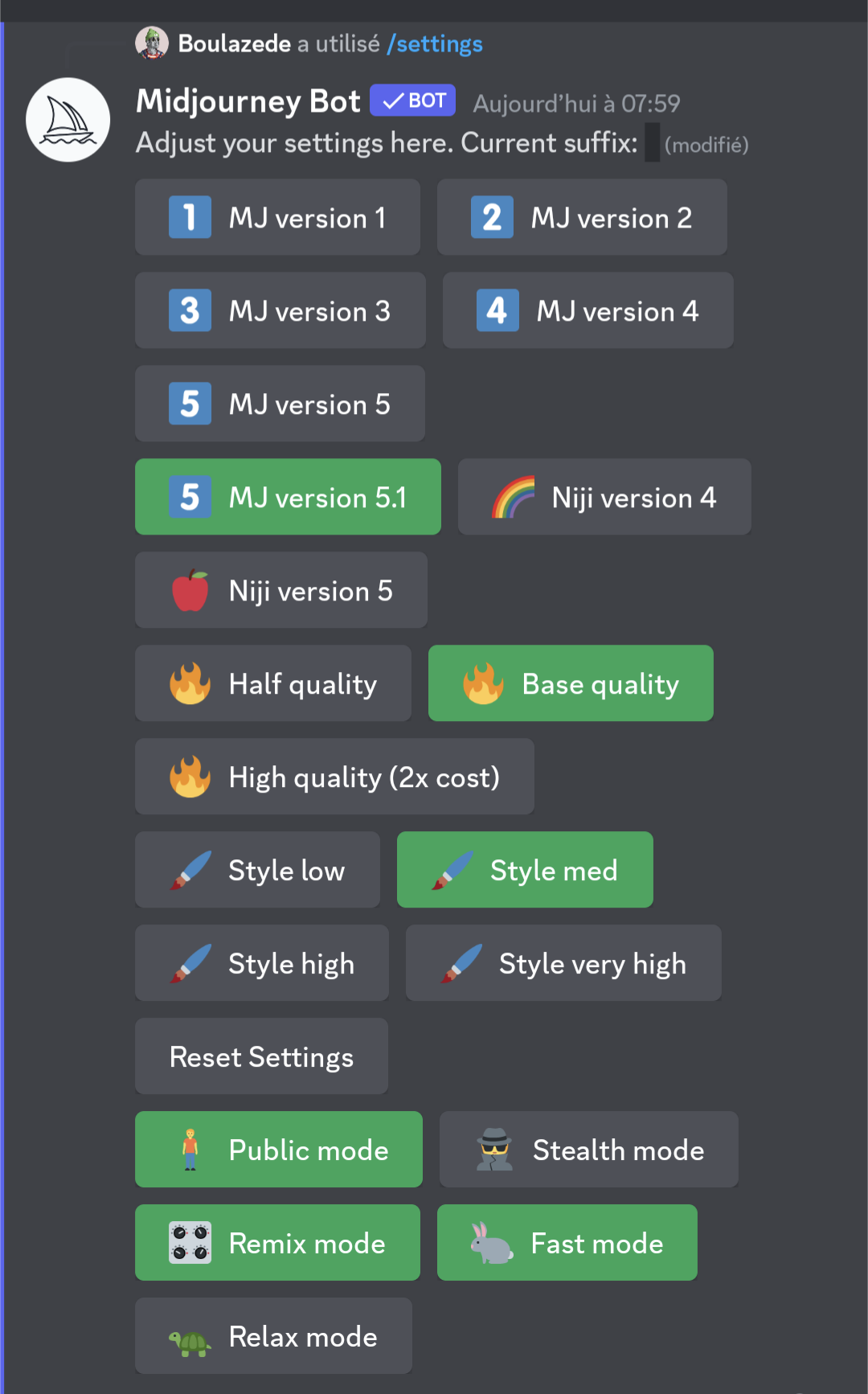

Pour l'activer, depuis le serveur Discord, tapez /settings et activez par défaut la version 5.1

Pour bien évaluer les différences et les similitudes, j'ai testé cette nouvelle version en utilisant les mêmes prompts dans la version 4, la 5 et la version 5.1 et en comparant les résultats. Tous les autres paramètres sont les mêmes.

D'abord un prompt Midjourney v4

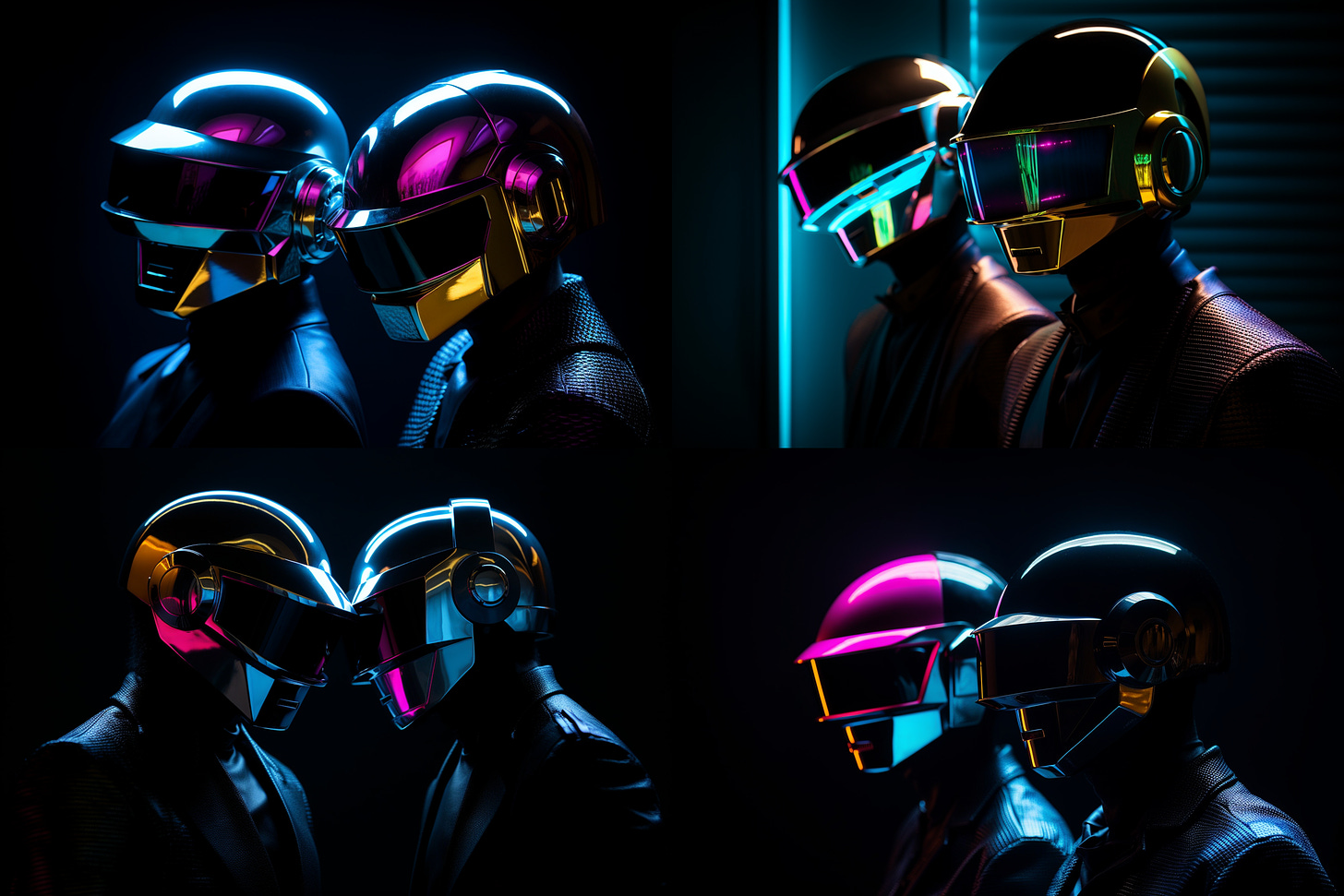

elegant daft punk, galaxy background, sci-fi, neon lighting, studio photoshoot, cinematic, ultra detailed, ultra realism --ar 3:2

v4

v5

v5.1

La V5 est clairement moins à l'aise avec cette syntaxe par mots clés caractéristique de la v4. Par contre la v5.1 s'en sort très bien, avec un résultat coloré, précis et stylisé, plus proche de la DA des Daft Punk que ne le sont la V4 et la V5. . On aime.

Continuons avec un prompt V5 :

Androgynous model wearing retro futuristic Adidas yellow running outfit cityscape editorial photography --ar 9:16

La V4

v5

v5.1

Comme on pouvait s'y attendre, la v4 propose un résultat stylisé mais moins photoréaliste que les deux autres versions. Difficile de départager la V5 de la v5.1 tant le résultat est qualitatif.

J'ai le sentiment que la v5.1 est plus solaire et apporte à l'arrière plan quelques caractéristiques (effets de lumière, contraste colorimétrique plus marqué) absentes de la V5, mais c'est subtil.

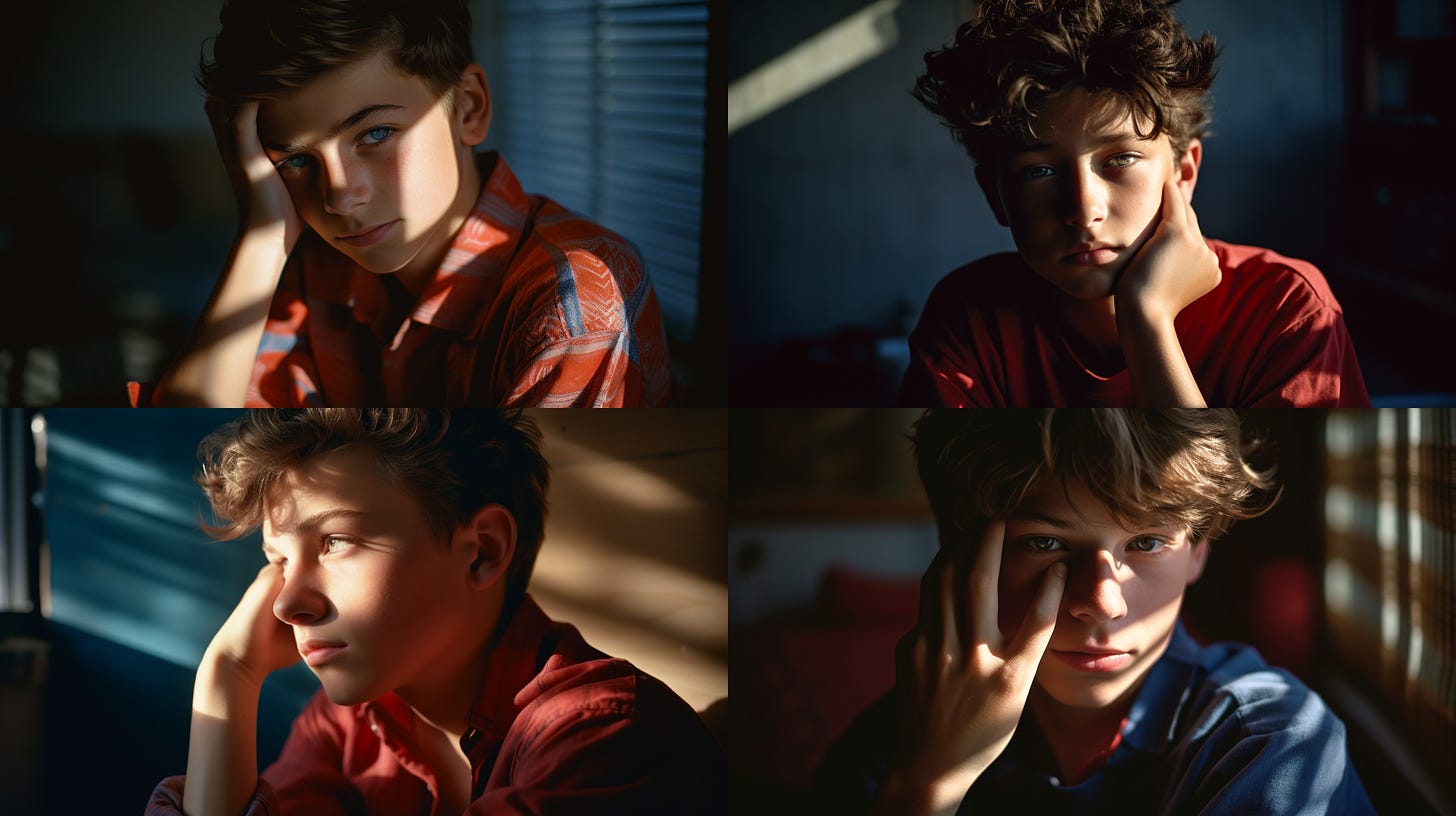

Comparons maintenant la V5 à la v5.1 dans l'exercice du portrait. Le prompt :

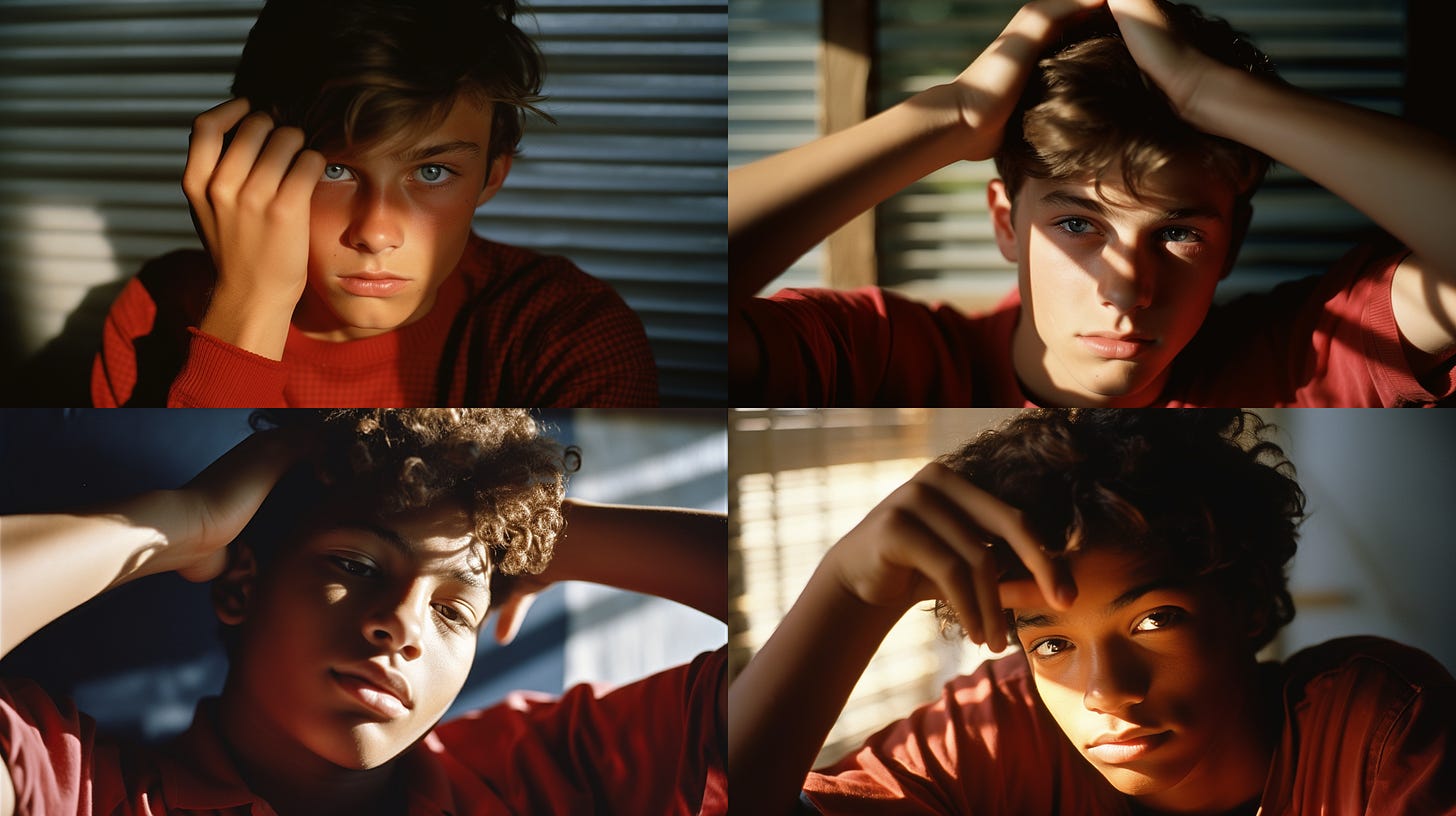

A teenaged boy sits in the light of late afternoon. His arm is up over his head partially shading his eyes. His eyes reflect the light, bringing out their blue. He wears an open red shirt with jewelery. Award - winning, portrait photograph shot with Kodak Portra 800, a Hasselblad 500C, 150mm f/4 lens, shallow depth of field, available light, high contrast, --ar 16:9

V5

v5.1

On remarque immédiatement que la v5.1 respecte mieux le contenu du Prompt que la v5, notamment pour la posture du personnage (“His arm is up over his head")

L'interprétation des indications de lumière est différente avec une image sensiblement plus solaire pour la V5.1 avec des teintes chaudes dans les hautes Lumières.

La V5 semble donner plus d'importance à la fin du prompt ("high contrast").

La v5.1 propose plus souvent des angles de caméra en contre plongée. Globalement, les images paraissent très légèrement plus nettes, les couleurs ressortent davantage.

Mais l'échantillon d'images de comparaison est faible, et les outputs aléatoires de Midjourney ont sûrement joué un rôle dans les différences constatées.

Quoi qu'il en soit, les deux versions produisent des résultats extrêmement qualitatifs, il m'est impossible de les départager.

Note : une nouveauté additionnelle de la v5.1 est le paramètre "--style raw"

Il semblerait qu'il supprime le style supplémentaire que la v5.1 ajoute par défaut à l'image. Ainsi, en termes de direction artistique, l'image ressemblera davantage à la v5 si vous utilisez --style raw dans votre prompt. En théorie.

Dans la pratique, ça dépend beaucoup du style de l'image produite.

Deux exemples :

Normal

RAW

Je trouve le style des 2 séries très similaire. Il faudrait faire davantage de tests avec du portrait, de l'architecture, des visuels oniriques, etc ..

Cette édition de GENERATIVE est maintenant terminée, merci de l'avoir lue jusqu'ici.

Abonnez vous pour ne rien manquer des prochaines éditions 👇

Bravo pour ces articles de super qualité ! Concernant Midjourney, tu utilises quel forfait ?

En ce qui concerne Midjourney et quelque soit la version, le plus dur finalement, c'est d'imaginer quoi "prompter" et bien sûr comment le "prompter" correctement mais bon en même temps c'est le propre de toute création artistique. L'IA n'enlève pas le syndrome de la page blanche.