Salut les androïdes, bienvenue dans cette 99e édition (déjà) de GENERATIVE, la newsletter hebdomadaire qui réussit à vous enthousiasmer chaque semaine, quand bien même vous luttez dans les sables mouvants des nouveautés du monde de l’IA générative.

Cette semaine, ça déborde et ça dépasse, un peu + que d’habitude. Fidèles à notre ligne éditoriale, nous faisons le focus sur les outils de génération d’images, de sons et de vidéos.

Nous ne vous parlerons pas de la sortie imminente de chatGPT 4.5, ni de l’extraordinaire fonctionnalité Deep Research désormais disponible pour les utilisateurs de chatGPT Plus. Sinon on ferait 7 pages.

Si vous voulez apprendre la génération d’images et de vidéos avec moi, je vous propose une session de formation fin mars à Paris, vous pouvez vous inscrire ici :

https://road-cream-7fa.notion.site/196826eb18dc80c49e64c3aad6449642

Sans plus attendre, accrochez vos ceintures, c’est parti let’s go !

🔹SORA for everyone

Hier soir encore, j’utilisais un VPN pour accéder à Sora. Mais ça c’était avant. Depuis cette nuit, Sora est disponible pour les utilisateurs Plus, Pro et Team dans l’UE, au Royaume-Uni, en Suisse, en Norvège, au Liechtenstein et en Islande. A vous les “hallucinations créatives”, comme dirait l’ami Rémi Rostan.

🔹PIXVERSE V4

Pixverse sort sa 4 , qui offre de nouvelles possibilités de faire du video-to-video (comme Runway Gen-3) et générer des audios en un clic seulement. Des générations plus rapides et une qualité toujours intéressante pour cet outsider en embuscade derrière le peloton de tête. Le rendu des images fait un poil trop “3D trop contrastée” à notre goût, mais rien qui ne saurait être corrigé en post production.

🔹LUMA Video-to-audio

Dream Machine ajoute la fonction video-to-audio pour sonoriser vos vidéos générées sur Luma. Deux options sont possibles : soit générer un son directement en un clic, soit en ajoutant une description détaillée. Disponible en bêta et gratuit pour l’instant… (Pourvu que ça dure!)

🔹Director minimax : Image-to-video-01-Director

Le mode “Director” de Minimax est désormais disponible en image-to-video (en + du text-to-video). Pour rappel, le director mode permet d’insérer des mouvements de caméra dans ses prompts pour un contrôle optimal de la mise en scène.

🔹Le quizz de la semaine

Cette semaine j’ai lancé un quizz vidéo sur Linkedin. Il fallait identifier chaque outil de génération de vidéo. Cette tâche ô combien impossible nous rappelle combien la compétition s’est durcie.

L’année dernière à la même époque, Runway et Pika se battaient en duel pour le titre de celui qui déformerait le moins. Aujourd’hui, ils sont plus d’une dizaine à prétendre au titre de générateur le plus réaliste. Voici la vidéo, avec les réponses au quizz :

(Musique Udio, Bruitages mmaudio + ElevenLabs)

🔹HUME AI : le nouveau concurrent d’ElevenLabs

Nos lecteurs de longue date se souviennent peut être de Hume, le chatbot empathique qui offrait une oreille compatissante à ses utilisateurs. Hume AI revient avec “Octave”, un modèle de synthèse vocale qui adapte ton, émotion et style à partir d’un simple prompt. Il va au-delà du simple Text-To-Speech car il s’adapte au contexte et interprète le sens et l’intention. A tester absolument sur hume.ai tant que c’est gratuit ! Merci à Elisabeth GRAVIL dans les premières à partager l’info en cette fin de semaine.

Warning : Hume excelle avec l’anglais. En français, c’est une toute autre histoire…

🔹KAIBER : Superstudio Pro

Kaiber est toujours vivant et ajoute ModelMaker à son Superstudio Pro, qui permet d’entraîner son propre modèle personnalisé et de l’utiliser ensuite en génération d’image et de video sur la plateforme. Petit bonus : les créations peuvent être regroupées en collections pour organiser votre travail.

🔹KAMUI

Kamui.ai est une plateforme japonaise qui regroupe des outils IA pour générer vidéos, images, voix et 3D. La plateforme intègre notamment Veo2 (en illimité apparemment !), Luma Ray2, Imagen3, ElevenLabs, Gemini 2.0, GPT-4o et d’autres modèles…

Pour la science, nous avons testé l’abonnement illimité (98$ tout de même) pour utiliser Veo 2. C’est un euphémisme de dire que l’ergonomie est extrêmement particulière et ne ressemble à rien d’autre sur le marché. L’interface est un simple champ de saisie dans lequel on colle notre prompt, suivi de “Use Veo2”.

Là, la plateforme va appeler l’API de Veo 2 via fal.ai, puis interroger Claude 3.5 Sonnet pour qu’il optimise le prompt. Il faudra ensuite appuyer sur un bouton “implémenter” pour lancer la génération. A la fin on télécharge un fichier zip avec plusieurs dossiers à l’intérieur. Très particulier… mais ça fonctionne, regardez ci dessous :

🔹WAN le new kid open source

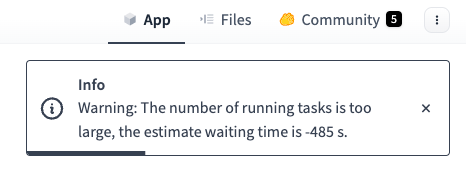

Wan 2.1 est un nouveau générateur chinois de vidéos. Il propose du text-to-video, de l’image-to-video et l’option édition sur des générations vidéos en 720p et en 480p sur les versions antérieures. Il est intéressant de voir que la génération propose spontanément des mouvement de caméra, en l’absence de précision dans le prompt. (Note de Caro : la précision “Static camera” m’a permis de limiter cette créativité du modèle). Par contre, armez vous de patience, l’attente est longue sur Huggingface, GitHub et Krea.ai. Mention spéciale à Fal.ai où la génération s’est faite en quelques secondes.

🔹 KREA ne perd pas de temps!

A peine sorti en open source, Wan 2.1 apparaît déjà dans la suite Krea AI. C’est qu’il faut être vif au pays des news IA Gen !

🔹 Wan 2.1 vs Veo 2

Curious Refuge a réalisé ce comparatif intéressant, qu’en pensez-vous ?

🔹 PIKA jamais loin !

Et effectivement, son frère ennemi Pika n’a pas pu résister et a dégainé dans la foulée sa nouvelle version 2.2 avec le dernier effet en date : les PikaFrames ! On en vient presque à se lasser de tant d’updates en si peu de temps…

🔹OPERATOR FREEPIK VEO 2 Tasty

Une démo de Omar Karim nous propose de combiner OpenAI Operator et Google Veo2 pour créer de façon structurée du contenu pédagogique et automatisé, ce qui pourrait remplacer les manuels et transformer la production de tutoriels tout en rendant l’IA autonome dans la création vidéo (#angoisse).

Avec cette méthode, on se demande parfois si toute cette histoire ne finira pas par appuyer sur un bouton pour tout régler…

🔹BYTEDANCE best Lipsync

OmniHuman-1 est le modèle de lipsync SPEC-TA-CU-LAIRE proposé par ByteDance, avec une synchronisation quasi parfaite des lèvres grâce à une reconnaissance faciale avancée, même sous des angles complexes. Il peut prendre en charge plusieurs visages et les corps entiers. Il s’adapte aux dialogues comme au chant et intègre les expressions faciales pendant un morceau. Petit + : les éléments qui passent devant la bouche n’interfèrent quasiment plus avec le rendu Annoncé pour Mars sur Dreamina AI de Capcut.

🔹La plateforme FLORA

FLORA est une nouvelle plateforme IA qui génère plans, personnages et vidéos à partir d’un scénario. Elle fonctionne avec des systèmes de nodes comme ComfyUI et permet aussi de recoloriser des images ou encore d’extraire des styles visuels. Dans la lignée des LTX dont on vous parlait ici, Animatix là ou encore The Next Stories évoqué dans la dernière édition, vous pouvez vous faire une idée sur cette démo de Amaete Umanah :

🔹RUNWAY FRAMES REF

Heather Cooper nous partage ici son workflow de “décor”. Elle explique comment elle utilise Runway Frames, pour son image de référence, puis ajuste le style en modifiant les presets de colorimétrie et les angles de vue afin d’affiner l’esthétique. Après avoir générer différentes séquences vidéos dans Runway Gen-3, cela lui permet d’ajuster et affiner sa direction artistique.

🔹CAST4 : IMG-2-3D

Encore à l’étape de projet, CAST4 propose de transformer une simple image en scène 3D détaillée par simple drag & drop. La promesse que nous relaie Haroun Prasath est de pouvoir reconstruire la géométrie complète des objets, même ceux partiellement cachés, ce qui pourrait être bien utile pour les artistes 3D, designers et développeurs voulant générer rapidement des environnements sans modélisation manuelle. Stay tuned !

🔹HEYGEN : Voice design

HeyGen permet maintenant de générer des voix de + en + précises juste avec un prompt qui indique l’âge, le genre, la langue et l’accent en venant directement chasser sur les terres d’Eleven Labs qui se fait chahuter cette semaine. Preuve en image :

🔹 ElevenLabs strikes back

Eleven Labs ne s’en laisse pas compter et lance “Scribe”, son nouveau modèle de reconnaissance vocale, qui serait supérieur à tous ses concurrents comme Gemini 2.0 et OpenAI Whisper v3 en matière de précision. Compatible avec 99 langues, il améliorerait considérablement le traitement des langues moins représentées comme le serbe ou le cantonais. Disponible dès maintenant dans l'interface et l'API à 0,40 $ par heure d'audio, avec 50% de réduction pendant six semaines.

🔹 LUMA dans Captions

Captions intègre 15 modèles d’IA pour générer images, voix, musique et vidéos directement dans son outil. Son premier partenariat ? Luma AI et son modèle Photon (spoiler alert : il est pas ouf) pour la création d’images. Dispo sur iOS et sur le web.

🔹Ça baisse !

Les coût des générations de Veo 2 est déjà en chute libre (comme le Bitcoin). Ainsi, les générations passent de 2.50$ les 5 secondes sur Fal.ai.

Et carrément à 55 centimes la génération sur Freepik, à condition de souscrire au plan Premium + à 36$ mensuels (ou 270$ par an avec le annual plan). Là où c’est moins rigolo, c’est que ça ne fonctionne pas avec les gens comme moi qui ont souscrit le Premium + à la sortie de Veo2 la semaine dernière. J’ai ouvert un ticket auprès du support qui est est en train de me ghoster avec assiduité.

Pas bien freepik.

🔹Living Encyclopedia de Dataland

Après le LNM dont on vous parlait ici , Dataland dévoile enfin Living Encyclopedia, une IA qui transforme les connaissances sur la nature en expériences interactives. Grâce à la génération d’images 4K et de cartes 3D, elle propose des visuels dynamiques, des sons et des interactions basées sur un index d’espèces issu de données éthiques. Accessible sur abonnement, elle accepte les paiements en crypto et offre 3 modes : Recherche, Création et Exploration. Essai gratuit sur dataland.art.

🔹La feature Freepik de la semaine

Connu pour sa précision du texte dans la génération, on peut maintenant ajouter le nouveau modèle d'Ideogram à leur AI Suite, offrant au passage des textures plus détaillées. Que manque-t-il à Freepik à votre avis ? Sora peut-être… A suivre !

Pour le texte, ça va. (un petit loupé en haut à droite quand même). Par contre, pour la génération d’image, beaucoup de variations et d’edit pour garder une cohérence visuelle globale. Au final, c’est pas ouf comme dirait Gilles !

Cette semaine, on n’a pas su choisir ! Alors on vous partage 3 pépites :

🔹Les excellents Dors Brothers ont encore frappé pour notre + grande bonheur avec cette nouvelle satire sociale !

🔹La seconde est un trailer non-officiel de Squid Game 2 : American Edition, pour lequel le studio créatif MRIIA a utilisé Runway, Sora, Veo, Pika et ElevenLabs.

🔹Pilule Bleu avec IA, Pilule rouge sans IA ?

L’IA transforme le cinéma : deepfake, réécriture de scénarios, générations visuels, VFX/SFX… Une interview The Verge bien réelle ici où Keanu Reeves évoquait déjà pour Matrix 4, la fracture entre ceux qui ont vu naître le numérique et ceux qui vivent déjà dedans. On vous laisse sur cette réflexion du week-end !

Cette édition est terminée, merci de l’avoir lue jusqu’ici ! Si elle vous a plu, vous pouvez la partager en cliquant juste ici :

Vous pouvez également me suivre sur LinkedIn et activer la cloche 🔔, je poste régulièrement sur l’intelligence artificielle générative. Vous pouvez également me contacter pour toute proposition de création, intervention, conférence, projet, formation liée à l’intelligence artificielle générative.

Et n’oubliez pas de vous abonner pour ne rien rater des prochaines éditions 👇

Merci pour la mention ;-) et pour tout le reste (intriguée par Flora). Le film des Dor Bros est un must-keep ! Quant à Dataland de Refik Anadol, je n'ai pas communiqué dessus, car j'avoue ne pas en comprendre le propos pour le grand public. C'est archi-conceptuel et surtout fait pour des data scientists, sans retombées pour la protection de la planète. Je vais me plonger plus avant dans le sujet. Petite question : avez-vous accès à Dreamina.ai de Capcut ? Je suis en liste d'attente depuis des mois !