Rentrer à la maison

Salut les francophones bienheureux, j’ai fait une expérience inhabituelle cette semaine. Après un séjour stimulant à la conférence E-AI à Montréal il y a deux semaines (récit dans l’édition 144), j’ai enchainé sur des vacances en Jordanie, avec ma famille.

Une semaine très intense avec les visites d’Amman la capitale, de sites antiques romains, de la magnifique Petra et du sublime désert du Wadi Rum avant de remonter dans le nord du pays où, la veille de notre départ, nous avons assisté au début du conflit dans la région.

Nous avons vu des missiles passer dans le ciel, la plupart interceptés, quelques uns s’écraser à l’horizon dans des bruits d’impact sourds.

C’était TRES impressionnant.

Et ça nous évoque des pensées de compassion avec toutes les populations qui subissent / qui ont subi des bombardements. Si l’enfer existe, il doit ressembler à ça.

Heureusement pour nous, la Jordanie est un pays “neutre” (gouvernement en bons terme avec Israël et les US, terre d’accueil des réfugiés palestiniens, opinion publique pro-palestinienne et favorable à l’Iran) ce qui lui confère un statut spécial : seules les bases américaines y sont bombardées. La vie a suivi un cours normal ici, entre les sirènes d’alerte de la ville et les avions de chasse dans le ciel.

Notre vol retour prévu dimanche dernier, soit 24h après le début des hostilités a évidemment été annulé et repoussé à jeudi… puis annulé. Nous avons pris des billets retour pour demain samedi, on croise les doigts.

Tout ça pour dire qu’en dépit de la situation, j’ai eu le temps de regarder ce qui se passait du côté de la GEN AI, bien aidé par la veille sans faille de Caro.

On vous raconte tout dans cette édition.

Let’s go !

Si tu es nouveau par ici, je suis Gilles Guerraz, réalisateur publicitaire devenu expert en outils créatifs GEN AI. J’ai fondé NEXTREND, organisme de formation spécialisé en outils créa IA et BANGGER, société de production audiovisuelle IA et hybride.

Avec Caroline Thireau (AI Creative Technologist), nous te proposons une plongée hebdomadaire dans la marmite bouillonnante de l’actualité de l’IA générative !

Si on t’a transféré cette lettre, abonne-toi en un clic ici.

Ma prochaine session de formation CPF aura lieu à Marseille les 19 et 20 mars prochains !

Si ce n'est pas déjà fait, tu peux aussi :

Découvrir mes formations IA pour les créateurs, 100% finançables par le CPF. Les inscriptions se font ici.

Former tes équipes à l'IA générative grâce à nos formations entreprise finançables par ton OPCO

Nous contacter directement pour discuter de ton projet IA générative

Me suivre sur LinkedIn, YouTube ou TikTok pour ne rien rater.

Et c'est parti ! 🚀

🔹 Kling 3.0 : Motion Control 3.0

Kling déploie Motion Control 3.0, une mise à jour de son système d’animation vidéo guidée par référence. Comme pour les autres solutions en video-to-video, on charge une vidéo (jusqu’à 30 secondes) pour transférer mouvements et mise en scène vers une nouvelle génération. Dans les améliorations : expressions faciales mieux interprétées, consistance des personnages plus stable et mouvements proches du mocap. Kling 3.0 permet aussi des vidéos multi-plans jusqu’à 15 s en 1080p et une génération d’images pouvant atteindre 4K.

🔹 Luma : Agents pour la production créative

Luma lance Luma Agents, des agents IA capables de gérer un projet créatif du brief jusqu’au rendu final. Le système coordonne vidéo, image, audio et texte dans un même workflow afin d’éviter de changer d’outil à chaque étape. L’objectif est d’accélérer l’itération et la production, tout en utilisant plusieurs modèles IA orchestrés dans la même interface.

🔹 NotebookLM : Cinematic Video Overviews

Google ajoute Cinematic Video Overviews dans NotebookLM Studio et monte la pression d’un cran. Cette fonction crée automatiquement une vidéo explicative à partir des sources importées (documents, notes, PDF). Le système combine plusieurs modèles IA pour produire une narration visuelle structurée, proche d’un mini-documentaire. Le déploiement est en cours pour les abonnés Google AI Ultra, mais uniquement en anglais pour l’instant.

Avis de Caro : On devine déjà l’avantage de résumer un corpus en vidéo immersive plutôt que de partager pdf de plusieurs pages ou audio de 20min.

🔹 Higgsfield Audio : voix off, doublage et traduction vidéo

Higgsfield étend sa plateforme avec Audio, un module dédié à la génération et au traitement de la voix. L’outil propose du text-to-speech avec 21 voix en preset (sa marque de fabrique) et la possibilité de créer 3 voix personnalisées. Il est aussi possible de remplacer la voix d’une vidéo et de traduire automatiquement le contenu avec doublage et synchronisation labiale. 10 langues sont supportées (anglais, français, chinois, hindi, italien, japonais, coréen, portugais, russe, turc).

Caro a hacké l’avatar de Gilles pour vérifier. Son verdict : c’est assez dingue avec un lipsync plutôt efficace et une latence de génération courte.

🔹 Higgsfield Soul Cinema

Higgsfield lance aussi Soul Cinema (preview), pour produire des visuels au rendu cinématographique à partir de son modèle maison Soul ID qui permet de garder la cohérence des personnages ainsi que son Soul HEX de la semaine dernière pour contrôler l’ambiance colorimétrique des rendus. La preview est annoncée accessible avec générations gratuites.

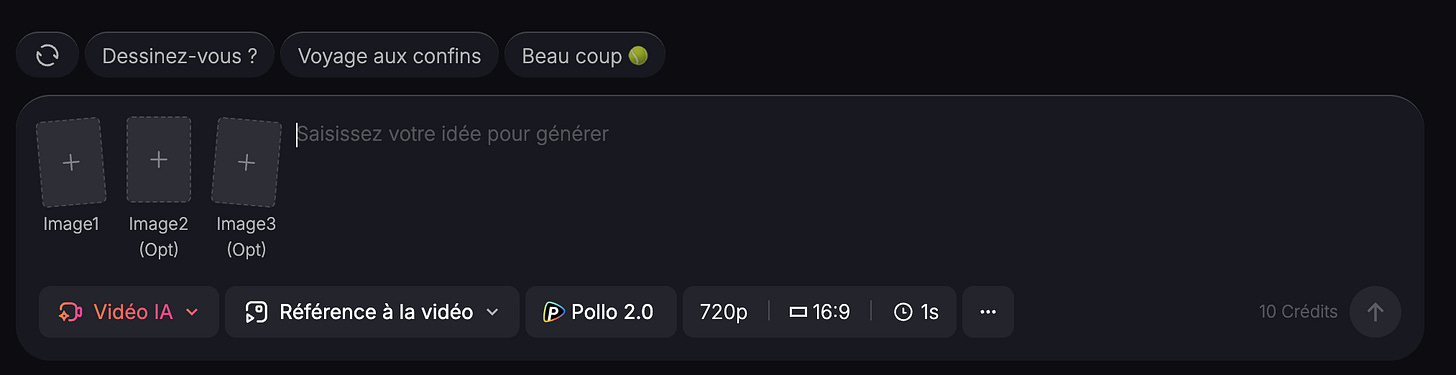

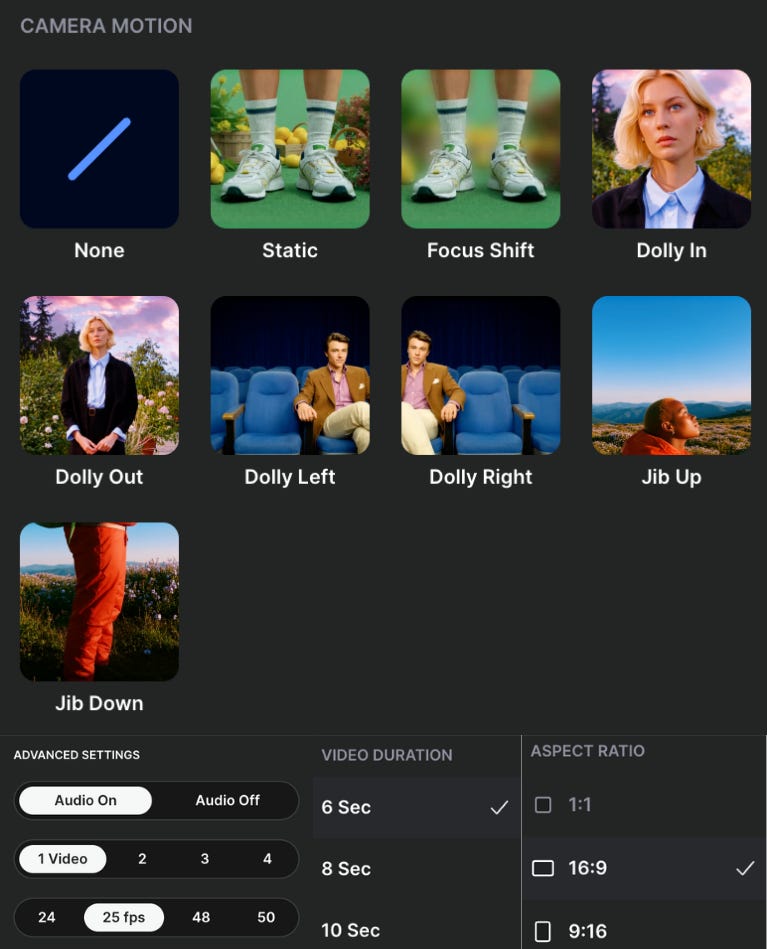

🔹 Vidu Q2 Pro & Pollo AI

Une news 2 en 1 pour vous parler du modèle Vidu Q2 Pro, désormais disponible dans Pollo AI. Il introduit un mode Reference-to-Video permettant de transformer une image ou une vidéo de référence en séquence générée avec une meilleure cohérence. La plateforme ajoute aussi des fonctions d’édition vidéo pour modifier, retoucher ou affiner un plan existant.

Avis de Caro : une interface qui ressemble aux dernières solutions Kling 3.0 et Seedance.

🔹 Krea : Voice Mode sur iPad

Krea ajoute un mode vocal sur son app iPad. Vous parlez pendant que vous dessinez et l’image se modifie en temps réel selon les instructions. (De quoi ravir Caro qui parlait déjà à ses devices depuis longtemps!)

🔹 Freepik Academy, plateforme de formation dédiée aux outils créatifs IA

Freepik lance son Academy, avec une plateforme de formation destinée à apprendre l’usage de ses outils créatifs (image, design et IA générative). Le contenu propose des cours structurés, tutoriels et workflows pour produire visuels, illustrations ou contenus marketing avec les outils Freepik.

Avis de Caro : malin pour évangéliser l’utilisation de la plateforme à l’heure des moocs !

En parallèle, Freepik nous partage son film produit en interne. Et s’ils annoncent une séquence émotion, c’est aussi un joli coup de com pour montrer qu’un pipeline de production audiovisuelle peut être construit directement dans leur écosystème, sans outils externes.

Voici un autre workflow video step by step basé sur Nano Banana 2 (design personnage), Magnific Video Upscaler (amélioration des détails) et Seedance 2.0, dont il se dit que l’intégration est imminente :

🔹 Flow : mise à jour du workflow de création vidéo IA

Flow, l’outil vidéo de Google Labs, reçoit une mise à jour qui améliore l’organisation des scènes dans un projet. La plateforme permet de générer plusieurs plans vidéo, de les structurer dans une timeline et d’ajuster chaque scène avec des prompts ou des références visuelles. Il est donc possible de créer des séquences vidéo complètes directement dans l’interface, avec un meilleur contrôle du montage et de la génération. On le savait que Google ne resterait pas les bras croisés, mais toujours pas d’accès en France.

🔹 Grok Extend

Grok ajoute une fonction pour prolonger une vidéo générée avec Imagine. Il est maintenant possible d’étendre un clip existant au lieu d’en recréer un nouveau. Cela permet de garder la continuité visuelle et la scène initiale tout en ajoutant de nouvelles secondes.

Avis de Caro : L’outil surfe clairement sur les platebandes de Capcut actuellement seule app à bénéficier de Seedance 2.0.

🔹 Seedance 2.0 : ça faisait longtemps !

D’ailleurs on vous partage ce comparatif entre la version standard et fast du modèle par László Gaál dont on apprécie le travail depuis un moment :

Comme à son habitude, Caro a également réalisé quelques tests de danse avec le modèle standard via Capcut sur son instagram (AI CrashTest plus complet en préparation).

Avis de Caro : rendu très réaliste à partir de cette image générée dans Midjourney. Par contre, les audios générés par Seedance ne sont pas toujours au rendez-vous.

🔹 Wonder Dynamics : Wonder 3D

Wonder Dynamics annonce Wonder 3D, outil de image-to-3D. Le système produit automatiquement le mesh, les textures et la géométrie afin d’obtenir un modèle prêt à être utilisé en animation, jeu vidéo ou VFX. Cela offre la possibilité de réduire les étapes classiques de modélisation et texturing en 3D et d’intégrer plus rapidement des personnages dans un pipeline de production. A voir en prod réelle. Dispo sur Autodesk.

🔹 FLUX.2 Pro : génération d’images 2× plus rapide

Black Forest Labs annonce une mise à jour de FLUX.2 Pro avec une vitesse de génération multipliée par deux, sans changement de prix ni perte de qualité. Le modèle reste orienté text-to-image, édition d’image et multi-références. Il est surtout utilisé pour photoréalisme produit, design et rendu de personnages (même si Gilles trouve ses rendus souvent trop contrastés), avec une bonne cohérence visuelle entre les générations. On vous laisse vous faire votre opinion sur cette génération en 13 sec. sur Scenario Nodes que Caro teste en ce moment :

A cinematic photorealistic travel photograph of an off-road jeep in the Jordanian desert, vast sandstone dunes and dramatic Wadi Rum rock formations in the background, adventurous travel atmosphere, golden hour sunset light casting long shadows across the sand

🔶 CÔTÉ OPEN SOURCE

🔸 LTX 2.3 & LTX Desktop

Lightricks présente LTX Desktop, un éditeur vidéo open-source fonctionnant directement sur le nouveau moteur LTX-2.3. Le logiciel tourne entièrement en local, optimisé pour GPU NVIDIA et matériel compatible. Il est également accessible sur la version web. L’idée est de générer et éditer des vidéos directement sur sa machine, sans passer par un service cloud, pour in fine construire des applications vidéo complètes autour du moteur LTX.

Avis de Caro : Lightricks prend la compétition IA comme un marathon en choisissant de développer la partie editing en local dans son écosystème.

Puisqu’on parle de LTX-2.3, sachez qu’il s’agit d’une mise à jour majeure du modèle précédent : plus de réalisme, audio plus propre, support natif de vidéo en format vertical (9:16), images clés d’entrée et sortie, caméra motion… Il existe en Pro et en Fast.

On a testé le modèle en Pro et on est moyennement convaincus :

Par contre, chez GENERATIVE, ça fait 2 ans qu’on pronostique que l’Open Source va un jour rattraper les outils d’éditeurs (d’où cette section). Et LTX 2.3 semble montrer la voie.

🔸 WorldStereo : génération vidéo et reconstruction 3D

WorldStereo est un système de recherche développé par Tencent Hunyuan et Zhejiang University qui cherche à générer des vidéos tout en conservant une logique 3D cohérente. Le modèle garde en mémoire la structure globale de la scène et les détails entre les différentes vues lorsque la caméra bouge. L’objectif est de produire des vidéos qui peuvent ensuite servir à reconstruire une scène en 3D plus facilement. Merci au camarade Stéphane PARSOIRE pour ce partage. Plus d’infos sur Github.

🔸 Helios : génération vidéo multi-vues et… reconstruction 3D !!

Même créneau que plus haut, Helios, développé par Peking University (Yuan Group), propose un modèle capable de générer plusieurs vues cohérentes d’une même scène à partir d’une image ou d’un prompt. Le système combine génération vidéo et contraintes géométriques pour améliorer la cohérence spatiale entre les plans pour permettre une meilleure stabilité. Les rendus à aujourd’hui n’ont pas convaincu la rédaction. Plus d’infos également sur la projet sous Github.

🔹 Asteria : pipeline hybride mêlant VFX, miniatures et rendu génératif

Le studio Asteria, dirigé par Paul Trillo,, a produit un film pour Aston Martin F1 Team avec l’infrastructure CoreWeave. Le projet combine live action, miniatures télécommandées, 3D, VFX et rendu génératif pour créer des environnements allant des dunes à la Lune. Le pipeline repose sur un contrôle image par image dans la timeline, avec jusqu’à 10 keyframes dirigées dans Cinema4D et Photoshop, puis directement intégrées dans un animatic 3D pour garder un contrôle précis des plans et des logos du véhicule.

Cette édition est terminée, merci de l’avoir lue jusqu’ici ! Si elle vous a plu, vous pouvez la partager en cliquant juste ici :

Vous pouvez également me suivre sur LinkedIn (Caroline est par ici) et activer la cloche 🔔, je poste régulièrement sur l’intelligence artificielle générative. Vous pouvez également me contacter pour toute proposition de création, intervention, conférence, projet, formation liée à l’intelligence artificielle générative.

Et n’oubliez pas de vous abonner pour ne rien rater des prochaines éditionsons 👇

Bon retour à la maison 🤞🏽