Nano Banana Returns

Salut les vidéastes augmentés, bienvenue dans cette 145e édition de Generative, la newsletter qui court après l’actu des outils de création visuelle avec l’intelligence artificielle générative.

Après le coup de tonnerre Seedance 2.0, cette semaine connait une relative accalmie. Des vacances en quelque sorte. Toutefois, quelques événements notables ont eu lieu, on vous raconte tout dans cette édition.

Let’s go !

Si tu es nouveau par ici, je suis Gilles Guerraz, réalisateur publicitaire devenu expert en outils créatifs GEN AI. J’ai fondé NEXTREND, organisme de formation spécialisé en outils créa IA et BANGGER, société de production audiovisuelle IA et hybride.

Avec Caroline Thireau (AI Creative Technologist), nous te proposons une plongée hebdomadaire dans la marmite bouillonnante de l’actualité de l’IA générative !

Si on t’a transféré cette lettre, abonne-toi en un clic ici.

Ma prochaine session de formation CPF aura lieu à Marseille les 19 et 20 mars prochains !

Si ce n'est pas déjà fait, tu peux aussi :

Découvrir mes formations IA pour les créateurs, 100% finançables par le CPF. Les inscriptions se font ici.

Former tes équipes à l'IA générative grâce à nos formations entreprise finançables par ton OPCO

Nous contacter directement pour discuter de ton projet IA générative

Me suivre sur LinkedIn, YouTube ou TikTok pour ne rien rater.

Et c'est parti ! 🚀

🔹 Nano Banana 2

La toile s’est enflammée à l’annonce de la sortie de Nano Banana 2, mais après vérification, il s’agit d’une version intermediaire entre Nano Banana 1 et Nano Banana Pro. Google maintient ainsi une offre à deux niveaux : Nano Banana Pro pour les tâches exigeant une précision factuelle maximale, et Nano Banana 2 pour la génération rapide avec ancrage dans la recherche d’images. Une sorte de “Nano Banana Pro Fast” en quelque sorte.

🔹 Freepik Spaces Nodes Audio

Freepik fait évoluer Spaces vers un véritable outil de production audiovisuel. Les nouveaux nœuds audio permettent d’ajouter des voix off via Gemini et ElevenLabs, de générer des effets sonores en boucles de 3 à 30 secondes et d’intégrer de la musique IA directement dans le même workflow que l’image et la vidéo grâce au Video Generator. L’objectif est clair : centraliser la production et éviter les allers-retours entre plusieurs outils en phase de postproduction.

🔹 Soul 2.0 Mode Soul HEX

Soul déploie Soul HEX dans son modèle image Soul 2.0 afin de permettre un contrôle colorimétrique précis via des codes hexadécimaux. Jusqu’à 10 000 générations gratuites sont annoncées, avec la possibilité d’importer 20 images de référence et de combiner ce mode avec des presets, SOUL ID, prompts et images sources. En revanche, aucune information n’est communiquée sur la résolution native ou les formats d’export.

🔹 Seedream 5.0 Lite

Seedream 5.0 Lite propose une génération multimodale qui combine texte, références visuelles et composition dans un même flux. Il intègre une recherche en ligne pour produire des visuels liés à l’actualité, accepte jusqu’à 14 images en multi-référence et offre un contrôle fin du style, des grilles de variations, un montage par annotation et un rendu de texte précis.

Certains parlent d’un Nano Banana Pro plus rapide et moins cher.

également dans Krea AI :

et chez Higgsfield :

🔹 Picsart AI & Providers Hub

Picsart lance AI Providers Hub au sein de ses Creative APIs afin de centraliser l’accès à plus de 20 modèles de génération d’images via une couche unique. L’outil permet de comparer les modèles côte à côte en termes de qualité, vitesse et coût, d’effectuer des tests et de versionner les résultats pour garantir la reproductibilité. L’objectif est de passer du test au déploiement sans modifier son pipeline technique.

🔹 Adobe Firefly & Quick Cut pour pré-montage automatisé

Adobe introduit Quick Cut dans Firefly pour générer une première structure de montage à partir de rushes existants ou de clips IA. L’utilisateur décrit le format attendu et l’outil assemble une ébauche narrative en sélectionnant automatiquement des moments clés, en intégrant du B-roll et en proposant une édition via une timeline basée sur la transcription. La promesse : réduire le temps face à une timeline vide.

🔹 FLORA et Claude Sonnet 4.6

FLORA intègre Claude Sonnet 4.6 afin de renforcer la gestion de workflows longs et multi-étapes. Le modèle est présenté comme plus stable sur la durée, avec une meilleure cohérence de ton et un suivi plus précis des intentions initiales lors des itérations. Le positionnement est orienté vers le contrôle créatif et la continuité dans les révisions.

🔹 Google Flow s’update

Flow ambitionne de devenir un studio de création entièrement basé sur l’IA. Google a repensé l’expérience utilisateur et intégré de nouveaux outils à l’interface :

🔹Preview Camera Bag

La plateforme Preview sort “Camera bag”, une fonctionnalité copiée fortement inspirée du “cinema studio” de Higgsfield. Choisissez votre boîtier, objectif, pellicule, ouverture, distance focale. Au total, ce sont plus de 10 000 combinaisons possibles.

🔹LTX Studio open weights

LTX Studio, développé par Lightricks, adopte une stratégie open weights sous licence commerciale. LTX-2 revendique plus de 3 millions de téléchargements sur Hugging Face en un mois. Le positionnement est clairement infrastructurel, avec API, studio collaboratif, versioning et gestion d’assets. La feuille de route mentionne un upscale 4K, une inférence locale sur laptop ou mobile et une extension multimodale.

🔹 VEED Dynamic Subtitles

VEED déploie Dynamic Subtitles, un système de sous-titres animés qui met automatiquement en avant certains mots clés pendant la lecture. Après import d’une vidéo, l’outil génère les sous-titres, applique un preset dynamique et synchronise l’animation au rythme vocal.

🔹 Seedance 2.0 & Omni

Seedance 2.0, en mode Omni, évolue vers une logique d’intégration pipeline. Testé à partir d’animations Unreal Engine issues de Matrix City Sample, l’outil améliore le rendu, densifie les particules et renforce l’atmosphère sans recréer la scène. Il analyse également l’image pour générer et synchroniser un design sonore cohérent. Le positionnement est celui d’un outil de postproduction assistée offrant plus de contrôle et moins d’aléatoire

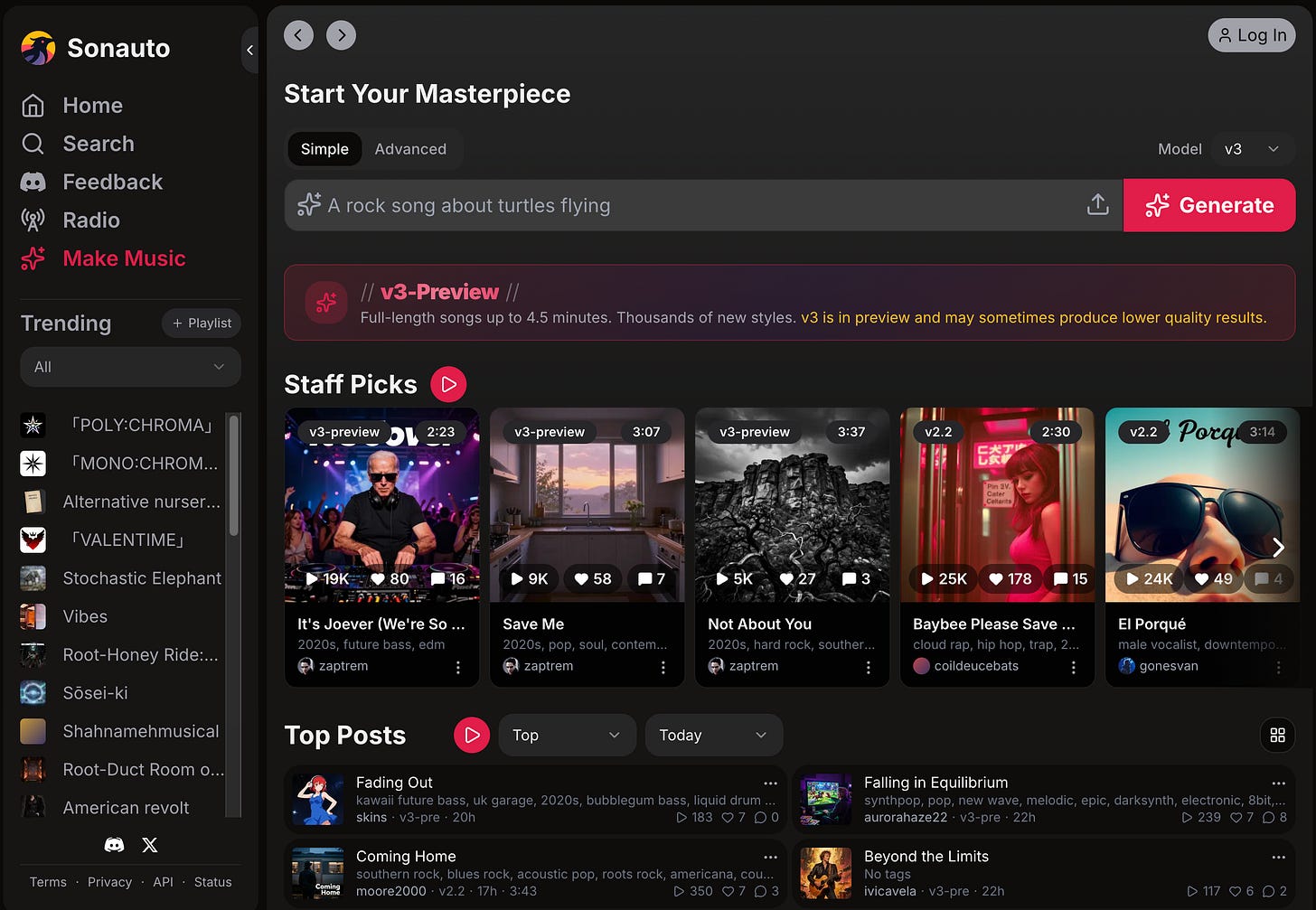

🔹 Sonauto.ai

Sonauto.ai permet de générer des morceaux à partir d’un simple prompt texte, incluant musique et voix chantée avec gestion des paroles et des genres. Les rendus sont propres pour des démos rapides, mais la cohérence musicale varie selon la complexité demandée. Aucune information détaillée n’est communiquée sur le bitrate ou les formats d’export avancés.

🔹 Seedance 2.0 clip Slid Off

Le clip “Slid Off” de Snoop Dogg, réalisé par Jesse Wellens, utilise Seedance 2.0 pour produire des séquences text-to-video complexes dans une esthétique de film de monstres en décor apocalyptique. La production est annoncée comme entièrement générée en IA, avec de multiples itérations pour stabiliser mouvements et cohérence visuelle.

🔹 Pika agents IA à mémoire persistante

Pika présente “Lui”, un agent IA personnalisable doté d’une mémoire persistante. L’utilisateur peut définir sa personnalité, l’intégrer à des discussions de groupe, lui faire générer des images ou lancer des projets interactifs. L’outil est positionné comme une entité numérique évolutive. Génial ou flippant ?

🔹 Refik Anadol reconnaissance institutionnelle + Dataland

Refik Anadol annonce son passage dans l’émission CBS 60 Minutes et l’ouverture prochaine de Dataland, un espace dédié à l’art data et IA. Son travail, déjà exposé dans plusieurs institutions internationales, s’inscrit dans une reconnaissance croissante de l’art génératif au sein des circuits culturels établis.

🔹 Reve v1.5

Reve annonce la version 1.5 de son modèle texte-vers-image avec une sortie en 4K. Cette release est présentée comme anticipée et déjà bien positionnée dans les classements Arena. L’accent est mis sur la résolution native.

Gilles a testé et désapprouvé ce modèle :

🔹 Stack IA de la semaine scène VFX sans équipe dédiée

Un créateur détaille un pipeline complet pour produire une scène VFX mêlant une enfant actrice et un paon en origami animé sans équipe dédiée. La direction artistique est réalisée via Midjourney, Leonardo, OpenArt et ImagineArt, la fidélité d’image optimisée avec Reve, Nano Banana Pro, DeepMind et Morphic, l’animation contrôlée via ByteDance, Dreamina, Kling, Vidu ou Seedance, puis le montage finalisé sur CapCut avec un sound design via Mirelo AI et ElevenLabs. L’ensemble illustre une logique de stack structurée, au-delà du simple prompt isolé.

🔶 CÔTÉ OPEN SOURCE

🔸MonarchRT & Infini AI Lab

Infini AI Lab présente MonarchRT, un accélérateur d’attention destiné à réduire la latence en génération vidéo. Une démonstration avec Wan 2.1 affiche une sortie en 480p à 16 images par seconde sur RTX 5090. L’objectif est de rapprocher la synthèse vidéo du temps réel en optimisant les blocs d’attention, sans information sur les résolutions supérieures ou la stabilité longue durée.

🔸 FLUX.2 Klein 9B face swap par reconstruction

Le workflow basé sur FLUX.2 Klein 9B propose un face swap par reconstruction complète image par image. L’identité est reconstruite en fonction de la lumière et de la géométrie réelles via une double référence et un ensemble de nœuds dédiés. L’échantillonnage en 4 steps avec un CFG bas vise à limiter la dérive, dans une logique plus structurée que les simples superpositions.Dispo via Floyo.

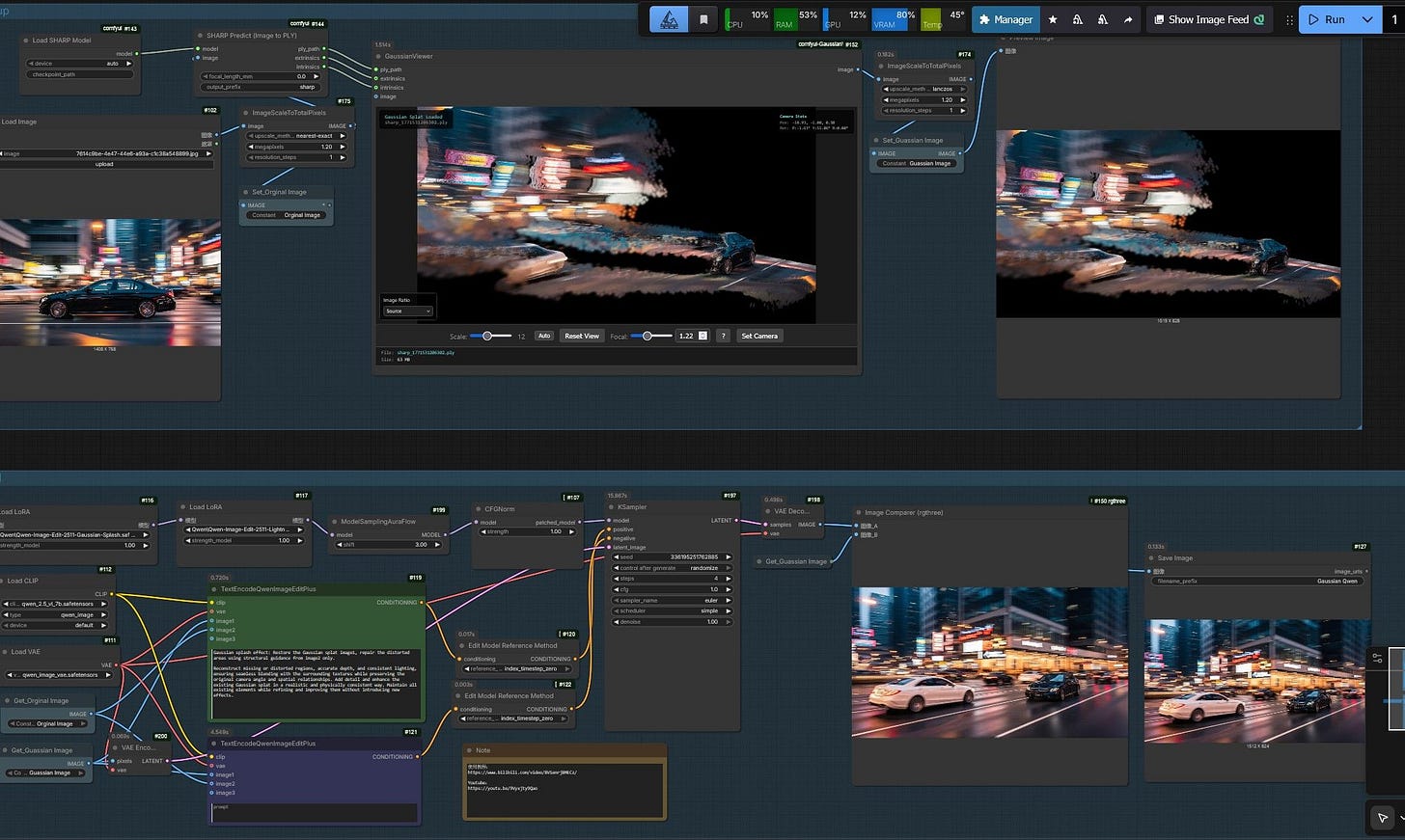

🔸 ComfyUI : Workflow local Gaussian Splats + Qwen Edit (Matthew Hallett)

Enfin, un workflow local ComfyUI présenté par Matthew Hallett permet de générer un Gaussian Splat à partir d’une image 2D unique puis de créer de nouvelles vues caméra. Un LoRA entraîné sur des Splats reconstruit les zones hors champ lors du déplacement. La principale limite reste le champ de vision contraint par l’image source, même si les résultats se rapprochent d’une approche LoRA multi-caméras pour l’inférence spatiale.

🔹 Simon Meyer participe au concours Higgsfield AI Action 500K avec ce film né d’une collaboration avec l’artiste IA Muhannad Nassar pour explorer différentes directions visuelles avant d’affiner chaque plan, du personnage jusqu’aux séquences d’action. Une douceur selon Caro !

Une parodie très bien découpée/réalisée selon Gilles.

Cette édition est terminée, merci de l’avoir lue jusqu’ici ! Si elle vous a plu, vous pouvez la partager en cliquant juste ici :

Vous pouvez également me suivre sur LinkedIn (Caroline est par ici) et activer la cloche 🔔, je poste régulièrement sur l’intelligence artificielle générative. Vous pouvez également me contacter pour toute proposition de création, intervention, conférence, projet, formation liée à l’intelligence artificielle générative.

Et n’oubliez pas de vous abonner pour ne rien rater des prochaines éditionsons 👇