Bonjour à tous les chatbots et aux humains qui nous lisent, et bienvenue dans cette 58e édition de GENERATIVE, la newsletter qui aborde l’actu de l’IA générative, les outils créatifs et donne la parole à des personnes qui font des choses inspirantes avec cette technologie.

Bienvenue également aux 219 lecteurs qui nous ont rejoint ces 30 derniers jours. Vous êtes désormais 2069 abonnés et un peu plus de 3200 lecteurs au total à lire cette newsletter chaque semaine. Je n’ose imaginer la fête pour célébrer la premier anniversaire de GENERATIVE lancée il y a (presque) pile poil un an.

Merci à vous tous de la lire chaque semaine ! Cette Newsletter n’existe que pour ses lecteurs. Si vous n’étiez que des chatbots en mal de scraping, je ne suis pas certain que je continuerais à la rédiger chaque semaine.

Sans plus attendre, le sommaire :

✔️ Les news de la semaine

✔️ La musique IA dans tous ses états : les meilleurs outils du marché

Les news de la semaine

Amazon et son IA “à la main”

Amazon abandonne progressivement sa technologie de shopping sans caisse, "Just Walk Out", utilisée dans plus de la moitié de ses supermarchés Amazon Fresh depuis 10 ans. Cette technologie permettait aux clients de quitter le magasin sans passer par la caisse, grâce à des caméras et capteurs, mais nécessitait en réalité le travail d’un millier de travailleurs indiens, donnant l’illusion de l’automatisation.

Techniquement parlant, Just Walk Out n’est pas une arnaque. Il y a bien une intelligence artificielle derrière ce système, qui utilise des caméras pour suivre les clients. Le problème est que Just Walk Out n’est pas toujours fiable, ce qui amène Amazon à recourir à des travailleurs humains pour vérifier les travaux de son logiciel.

SpotifAI

Spotify lance une fonctionnalité en version bêta au Royaume-Uni et en Australie qui permet de créer des playlists personnalisées via IA. Les utilisateurs écrivent des commandes qui, combinées à leur historique musical, génèrent des playlists sur mesure. Accessible via l'application, cette option propose d'ajuster les sélections avec des commandes supplémentaires et de sauvegarder les playlists dans la bibliothèque de l'utilisateur. Disponible uniquement avec VPN en dehors des régions de test.

Visionnaire

Quelle est votre définition du mot “visionnaire” ? S’applique t-elle à ce discours de Steve Jobs qui, en 1985, nous expliquait déjà l’arrivée de chatGPT.

Chez Casto y’a tout ce qu’il faut

Castorama lance Hello Casto, un assistant virtuel alimenté par l'IA, capable de répondre à des dizaines de milliers de questions liées au bricolage et à l'amélioration de la maison. Développé à partir de l'agrégation de trois modèles de langage à grande échelle - PaLM de Google, ChatGPT d'OpenAI et Claude d'Anthropic - Hello Casto vise à fournir des réponses pertinentes et personnalisées. Entraîné sur une base de données complète comprenant textes, images, guides de formation et vidéos, cet assistant utilise un apprentissage semi-supervisé pour s'adapter continuellement aux besoins des clients.

The Virtual GF business

MyShell, plateforme basée à Tokyo spécialisée dans la création d'"amies virtuelles" et d'applications de productivité via la blockchain, a levé 11 millions de dollars lors d'un tour de pré-série A, portant son financement total à 16,6 millions. Environ 40% du contenu créé par la communauté concerne les amies virtuelles/compagnons IA, mais "l'objectif principal de la plateforme open source MyShell serait de permettre aux créateurs de construire des applications IA personnalisées dans une gamme diversifiée plutôt que de se concentrer uniquement sur les compagnons IA."

AI Film Festival

La deuxième édition du festival du film AI revient le 1er mai à Los Angeles et le 9 mai à New York. Les finalistes sont dévoilés aujourdh’ui à aiff.com

Ce qui frappe dans ce teaser, en dehors du niveau qui semble assez relevé, c’est le nombre d’extraits qui semblent avoir été filmés et non générés. Est-ce le signe que les outils d’IA ne sont pas encore au niveau souhaité par les réalisateurs (fort probable) ? Ou que certains ne sont pas encore prêts à lâcher leur caméra ?

Un robot fait maison

Le réalisateur californien Jon Finger a créé un robot en 3D ans une vidéo devenue virale. Il explique le workflow utilisé pour générer le robot dans la vidéo ci dessous :

✏️ Esquisse dans Procreate

🖼️ Transfert de style dans MagnificAI

🤖 Converti en 3D dans 3DAIStudio

🕺 Capture de mouvement avec Move AI

🎥 Suivi de caméra et rendu dans C4D

La démocratisation de la création 3D est en marche :

Meta accélère

Meta a lancé la nouvelle génération de sa famille de puces IA, le Meta Training and Inference Accelerator (MTIA), avec des performances triplées par rapport à la version précédente. Ces puces, qui améliorent déjà les modèles de recommandation et de classement de Meta, seront bientôt utilisées pour des modèles GenAI comme Lllama. Meta redouble d’efforts pour rivaliser avec Google, Amazon et Microsoft dans la course à l'IA, tout en réduisant sa dépendance aux GPU Nvidia coûteux

Des films IA au cinéma

Artefact et mk2 s'associent pour lancer la première édition d'un festival de films réalisés avec des outils d’intelligence artificielle. Ouvert à tous, il s’agit d’un concours international, les courts métrages soumis ne doivent pas dépasser une durée maximale de 314 secondes. Chaque film doit avoir utilisé au moins une technologie d'intelligence artificielle générative dans chacune des trois phases de production cinématographique : pré-production, production et post-production. le site du festival permet de soumettre ses créations et de voter pour les œuvres sélectionnées.

Deadline : 1er octobre.

https://artefact-ai-film-festival.com/

Humane, clap de fin ?

Vous vous souvenez de L'Humane Ai Pin, un appareil portable sans écran développé par d'anciens employés d'Apple, qui visait à remplacer les smartphones ? Malgré un investissement de 240 millions de dollars et le support de grandes entreprises technologiques, il n'a pas répondu aux attentes. Après évaluation, The Verge critique sévèrement l'appareil pour son manque de fonctionnalité et d’ergonomie, sa faible performance et ses nombreux bugs. Il conclut que l'Humane Ai Pin est trop limité et bugué pour être une alternative viable au smartphone.

Will another one bite the dust ?

Avec sa technologie de clonage plug and play, Heygen a ouvert la brêche d’un marché gigantesque, qui attire de nombreux compétiteurs. Le dernier en date se nomme Digen.ai.

La gestuelle est un peu figée, le français est moins bon que l’anglais ou l’espagnol mais c’est pour le moment ce qui se fait de mieux en la matière…. derrière HeyGen.

D’autre acteurs, comme les camarades de la startup française Argil ont également investi ce créneau avec des résultats très prometteurs pour la suite.

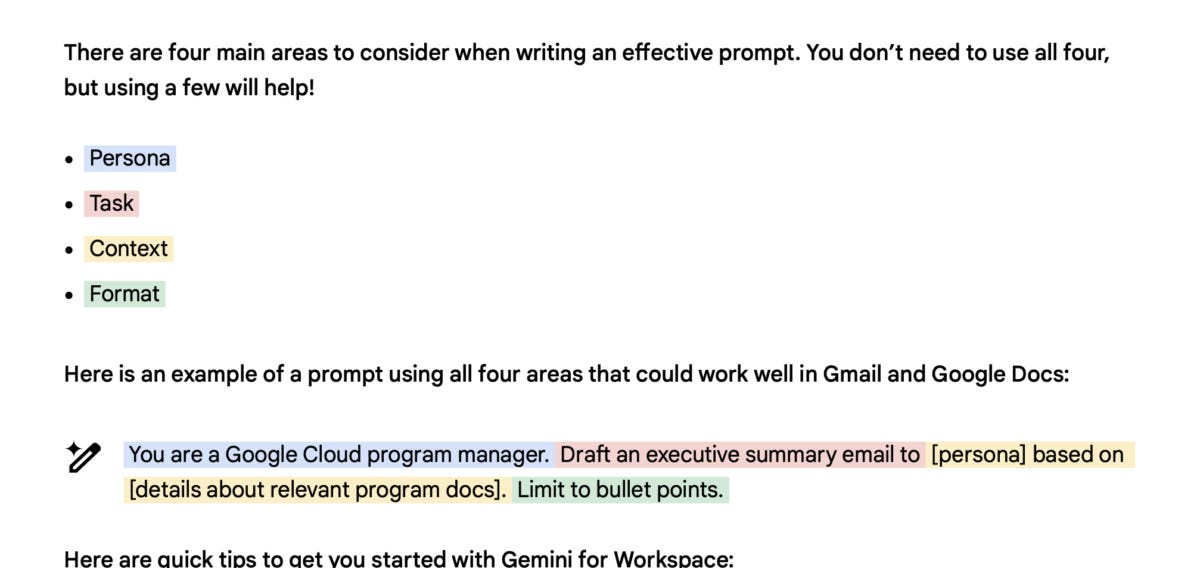

Le petit manuel du chatbot

Google a lancé un guide de 45 pages lors du récent événement Google Next 2024 pour optimiser l'utilisation de Google Gemini, OpenAI ChatGPT, et Microsoft Copilot. Ce manuel gratuit, disponible après inscription, fournit des conseils pour formuler des prompts précis en spécifiant sujet, tâche, contexte et format, en utilisant un langage naturel et en enrichissant les interactions avec des détails contextuels, aidant ainsi à mieux intégrer l'IA dans le quotidien. Merci au site Frandroid qui met gratuitement ce manuel à disposition des utilisateurs.

OpenAI chasse sur les terres d’Eleven Labs

La semaine dernière, je vous parlais de “Voice Engine”, le nouvelle technologie d’OpenAI capable de cloner une voix à partir d'un court échantillon. Voici une courte vidéo de démo de l’outil en action. Qu’en pensez vous ?

Les deepfakes bientôt punis par la loi

L'Assemblée nationale a récemment adopté une loi pour réguler les deepfakes, ces contenus visuels ou sonores générés par IA qui imitent les images ou paroles de personnes sans leur consentement. La nouvelle législation prévoit des sanctions sévères : jusqu'à deux ans de prison et 60 000 euros d'amende pour les deepfakes à caractère sexuel, et un an de prison avec 15 000 euros d'amende pour les autres types. Toutefois, pour qu'un deepfake soit punissable, il doit être non consenti et ne pas être clairement identifié comme créé par IA.

Ouf, on peut continuer à regarder notre Président chanter des tubes d’Angèle.

Et en même temps je sens qu’on va tous être rapidement blasés de voir les mêmes blagues en boucle dans nos timelines

LA MUSIQUE IA DANS TOUS SES ETATS

La musique générée par l’IA est, davantage encore que le domaine de la génération d’images ou de vidéos, un domaine où les disparités sont très fortes.

En une phrase : c’est le royaume du meilleur comme du pire.

(Presque) tout le monde connait désormais Suno, la star de la génération musicale assistée par l’IA, capable de “composer” des morceaux mélodieux avec du chant sur des paroles personnalisées en moins d’une minute.

D’ailleurs, avec ma camarade d’exploration IA Laura Ghazal, nous vous avons concocté un épisode de podcast consacré à Suno, le générateur musical dont tout le monde parle de puis quelques semaines.

Il est disponible sur toutes les plateformes.

Pourquoi Suno ? Parce que c’est le plus ludique, et le meilleur… jusqu’à cette semaine.

Et oui, déjà.

Une métaphore que j’aime utiliser pour représenter la vitesse d’évolution de l’IA générative, c’est la sensation d’être assis dans un TGV qui ne cesse d’accélérer.

En préambule, il faut savoir qu’il existe tout un tas de plateformes que nous ne nommerons pas, qui promettent de la génération musicale. Dans le monde réel, je parlerais plutôt de régurgitations aléatoires de cacophonies inaudibles, même avec la meilleure volonté du monde.

Peu d’outils tirent réellement leur épingle du jeu. Mon préféré derrière Suno, c’est

STABLE AUDIO

Stable Audio, de Stability AI propose désormais un nouveau modèle assez extraordinaire, AudioSparx 2.0.

Ecoutez ce que j’obtiens avec le prompt suivant :

”Trip Hop, Cinematic, soundtrack, Bristol, Drum Kit, Bass, Rhodes, Choir, Cool, Moody, Melancholic, Atmospheric, Dreamy, groovy, introspective, thoughtful, beautiful, 85 BPM”

L’écoute me donne très envie de réaliser des images. Je vais essayer de faire ça à l’ancienne (c.à.d. Midjourney + Runway, so 2023) en attendant Sora.

Et le killer feature, c’est la possibilité de “remixer” un morceau (libre de droits) que vous avez en votre possession. J’y reviendrai plus tard.

Bref, figurez vous que cette semaine, ce n’est pas un mais 2 nouveaux outils qui ont retenu mon attention. Le premier c’est :

CASSETTE AI

Cassette AI est une plateforme de génération musicale assistée par l’IA, qui propose son propre GPT. Si vous n’avez pas d’abonnement chatGPT Plus, vous pouvez y accéder directement sur leur site.

L’interface est ultra simple : vous saisissez un prompt, le modèle génère un morceau de 20 secondes en approximativement une minute.

20 secondes c’est un peu court, alors j’ai généré 1mn de musique. Ça prend environ 3 minutes.

Je trouve la qualité intéressante, légèrement inférieure à celle proposée par Stable Audio, d’autant plus que le morceau n’a ni début ni fin. Il démarre et se termine brutalement. Mais globalement, la qualité est plutôt satisfaisante, écoutez.

J’ai modifié le prompt de Stable Audio après avoir eu l’impression, à tort ou à raison, que les prompts trop longs avaient tendance à produire des morceaux moins mélodieux avec Cassette AI.

Exemple :

Du coup, j’ai raccourci à ça :

”Trip Hop Cinematic”

Alors non, ce n’est clairement pas aussi mélodieux que Suno ou la dernière version de Stable Audio MAIS :

- Rappelons que nous que Stable Audio était cacophonique jusqu’à récemment

- Que Cassette AI n’en n’est qu’à sa v1 et que des évolutions sont à attendre

- Cassette propose d’autres fonctionnalités uniques

En effet, là où Cassette AI brille, c’est moins sur la qualité sonore de ses générations (2-3 beats à contre tempo) que sur l’éventail de fonctionnalités qu’il propose :

- on peut séparer les pistes. Exemple avec les percussions du morceau généré plus haut :

- la basse (discrète il est vrai)

- ou le reste de l’instru

Plus impressionnant, Cassette propose de générer de la musique à partir d’un fichier vidéo. J’ai essayé avec des vidéos issues d’un projet personnel work in progress :

Je trouve le résultat intéressant au sens où la proposition n’est pas à côté de la plaque. Cassette ne m’a pas proposé du heavy metal ou de la disco sur la base des images que je lui ai fournies.

De manière assez étonnante, le modèle semble en capacité d’analyser le contenu de la vidéo pour proposer une mise en musique cohérente. 2e test avec du stock vidéo :

Si la version gratuite est bridée par quelques limitations (notamment l’impossibilité de télécharger vos créations musicales), la version “Pro” est accessible pour la modique somme de 3.99$ par mois. Avec pas mal de possibilités :

Cassette AI n’est pas nouveau à proprement parler, c’est sorti il y a deux mois environ. Il était simplement passé sous mon radar. Pour moi il mérite le détour pour ses nombreuses fonctionnalités et son tarif hyper accessible.

Mais la très grosse news de la semaine, c’est la sortie d’un “Suno Killer” (déjà !) qui répond au doux nom de :

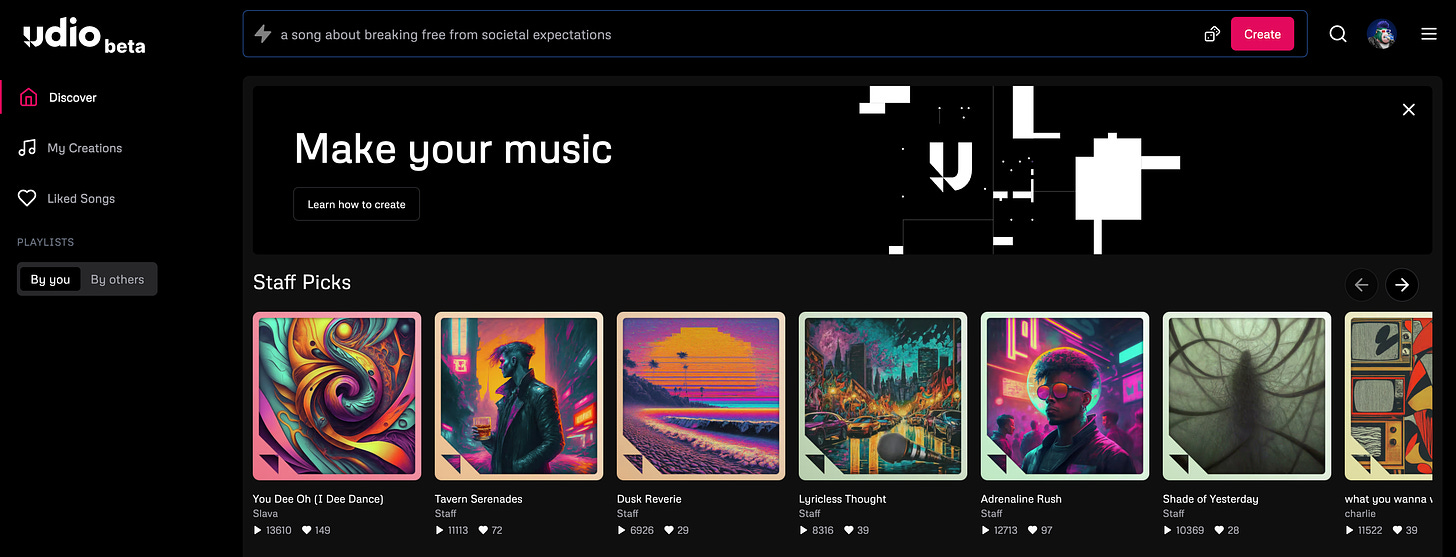

UDIO

Sorti cette semaine, Udio a déjà fait couler beaucoup d’encre numérique.

Cette nouvelle application, créée par une équipe d'anciens chercheurs de Google DeepMind, ressemble beaucoup à Suno, tant dans son apparence que dans son fonctionnement. Les deux applications utilisent un modèle de langage pour écrire les paroles et un modèle de diffusion audio pour rendre la musique, mais Udio semble offrir une meilleure interface utilisateur, plus d'options de personnalisation et, [Spoiler Alert], des résultats de meilleure qualité.

Concrètement, Udio fonctionne à peu près comme Suno. Vous pouvez générer un morceau instrumental ou avec des paroles de 33 secondes, selon un genre musical que vous définissez (ou pas), en quelques clics.

La différence majeure, et il faut l’entendre pour le croire, c’est que la qualité sonore est supérieure à celle de Suno déjà excellente.

Udio propose également d’autres fonctionnalités comme la possibilité d’étendre un morceau existant. Les utilisateurs peuvent le faire en cliquant sur le bouton "étendre" et en choisissant d'ajouter une introduction, une section supplémentaire ou une conclusion.

En ce qui concerne les limites de genre, Udio peut être poussé à créer des chansons qui imitent le style d'artistes spécifiques. Cependant, ces chansons peuvent ne pas toujours ressembler parfaitement à l'artiste original et peuvent plutôt ressembler à un “dérivé” du style musical de cet artiste.

En parlant d’artistes, certains musiciens reconnus, comme Common et Will.i.am, comptent parmi les investisseurs.

En outre, Udio est toujours en version bêta, il est donc possible de tomber sur des morceaux de mauvaise qualité. Mais la plupart des chansons générées sont de très haute qualité.

Ecoutez ce que j’obtiens en recyclant le prompt utilisé en début d’article :

”Trip Hop, Cinematic, soundtrack, Bristol, Drum Kit, Bass, Rhodes, Choir, Cool, Moody, Melancholic, Atmospheric, Dreamy, groovy, introspective, thoughtful, beautiful, 85 BPM”

Tout ça m’évoque le brouillon d’un titre de Massive Attack.

La génération est plus longue qu’avec Suno aux heures de pointes (l’après midi d’après mes premiers tests), mais ça vaut clairement le coup d’attendre.

J’en ai profité pour composer générer un hymne pour cette newsletter. Bien ou bien ?

J’ai essayé une musique de trailer en “spoken words'“, amusant à défaut d’être convaincant

Les césures sont mal placées. et Skynet et prononcé “Ski-Net”, ça ruine un peu la ref.

Comme j’étais chaud bouillant, je me suis lancé dans la génération des tube de l’été 2024. Lequel préférez-vous ?

Ensuite j’ai eu envie de tester un morceau façon “Rage Against The Machine”

C’est pas EXACTEMENT ça (le flow de Zach de la Rocha est irremplaçable) mais l’intention est là, c’est pas mal du tout.

Dans un style différent, j’ai obtenu ça avec le même prompt. ça envoie.

C’est le moment où je suis revenu sur Stable Audio pour essayer de remixer ce morceau. J’ai trouvé le résultat sans intérêt.

Puis j’ai eu l’idée de réutiliser mon tube de l’été un peu mou en le rallongeant avec le même prompt que celui utilisé pour le track façon RATM. Le résultat est très aussi brutal que discutable mais je trouve génial de pouvoir changer de style en cours de morceau, un peu comme au milieu du film “From dusk till dawn” de Robert Rodriguez.

Allez, trève de blabla, voici comment commencer à utiliser Udio gratuitement dès maintenant :

1. Allez sur udio.com et créez un compte gratuit.

2. Saisissez un prompt dans la zone de saisie en haut de l'écran, ou cliquez sur le bouton avec les dés pour obtenir une suggestion aléatoire.

3. Choisissez si vous souhaitez une piste instrumentale, écrire vous-même les paroles, ou les générer automatiquement.

4. Cliquez sur le bouton rouge "Créer" à droite de la boîte de texte.

5. Écoutez votre nouvelle œuvre d'art dans l'onglet "Mes Créations" à gauche.

La version actuelle est la première version bêta publique d’Udio, et vous pouvez tester jusqu'à 1200 (!) chansons par mois tant qu'elle est encore en bêta. Il n'y a pas de communication officielle d'Udio sur la durée de la bêta, alors dépêchez-vous, cela ne devrait pas durer longtemps !

Faites attention, c’est très addictif. Bon week end !

Cette édition est terminée, merci de l’avoir lue. Si elle vous a plu, vous pouvez la partager en cliquant juste ici :

Vous pouvez également me suivre sur LinkedIn et activer la cloche 🔔, je poste régulièrement sur l’intelligence artificielle générative. Vous pouvez également me contacter pour toute proposition de création, intervention, conférence, projet, formation liée à l’intelligence artificielle générative.

Et n’oubliez pas de vous abonner pour ne rien rater des prochaines éditions 👇

Au top Gilles 👏🏻👏🏻👏🏻👏🏻